机构名称:

¥ 1.0

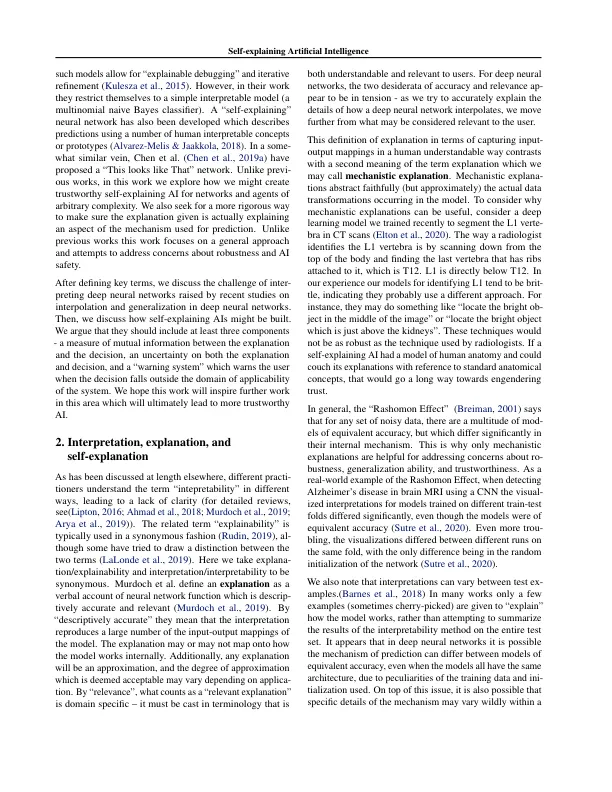

虽然通常可以用一些人类可理解的规则来近似深度神经网络的输入输出关系,但双下降现象的发现表明,这种近似不能准确捕捉深度神经网络的工作机制。双下降表明深度神经网络通常通过在数据点之间平滑插值而不是提取一些高级规则来运行。因此,在复杂的现实世界数据上训练的神经网络本质上很难解释,如果被要求进行推断,则容易失败。为了说明我们如何能够信任人工智能,尽管存在这些问题,我们探索了自我解释人工智能的概念,它既提供预测,也提供解释。我们还认为,人工智能系统应该使用适用性领域分析和异常检测技术来包含一个“警告灯”,以便在要求模型在其训练分布之外进行推断时警告用户。

自我解释人工智能作为可解释人工智能的替代品