机构名称:

¥ 2.0

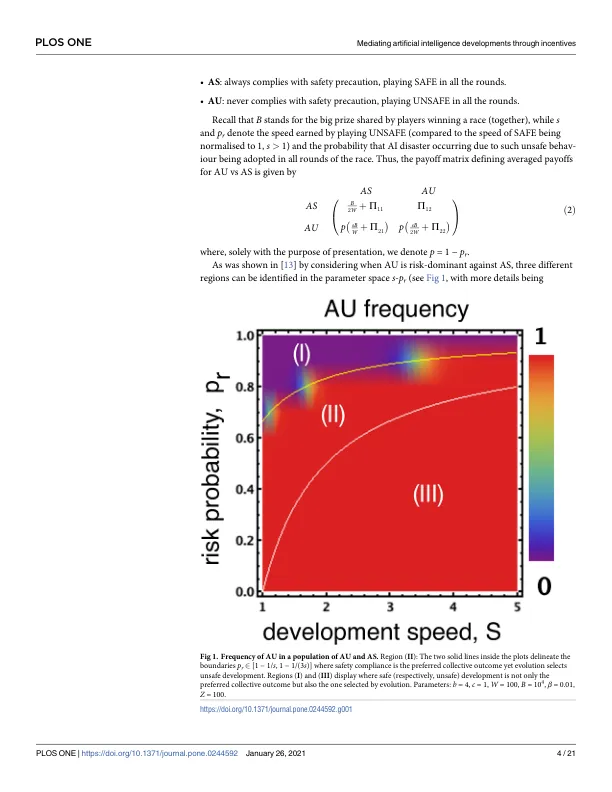

人工智能 (AI) 领域正处于一个被寄予厚望的时期,这在研究、商业和政策方面引发了一定程度的焦虑。人工智能竞赛的叙事进一步加剧了这种焦虑,让人们相信他们可能会错失良机。无论是否真实,相信这种叙事可能是有害的,因为一些利益相关者会觉得有必要在安全预防措施上偷工减料,或者为了“获胜”而忽视社会后果。从一个描述获胜者比其他人获得显著利益的广泛技术竞赛(如人工智能进步、专利竞赛、制药技术)的基线模型开始,我们在此研究积极(奖励)和消极(惩罚)激励措施如何对结果产生有益影响。我们发现,在某些情况下,惩罚要么能够降低不安全参与者的发展速度,要么能够通过过度监管来减少创新。或者,我们表明,在几种情况下,奖励那些遵守安全措施的人可能会提高发展速度,同时确保安全的选择。此外,在后一种制度下,奖励不会像惩罚那样受到过度监管问题的影响。总体而言,我们的研究结果为在平稳和突然的技术转变背景下最适合提高安全合规性的监管行动的性质和种类提供了宝贵的见解。

研究文章通过负面和正面激励来调节人工智能发展