机构名称:

¥ 1.0

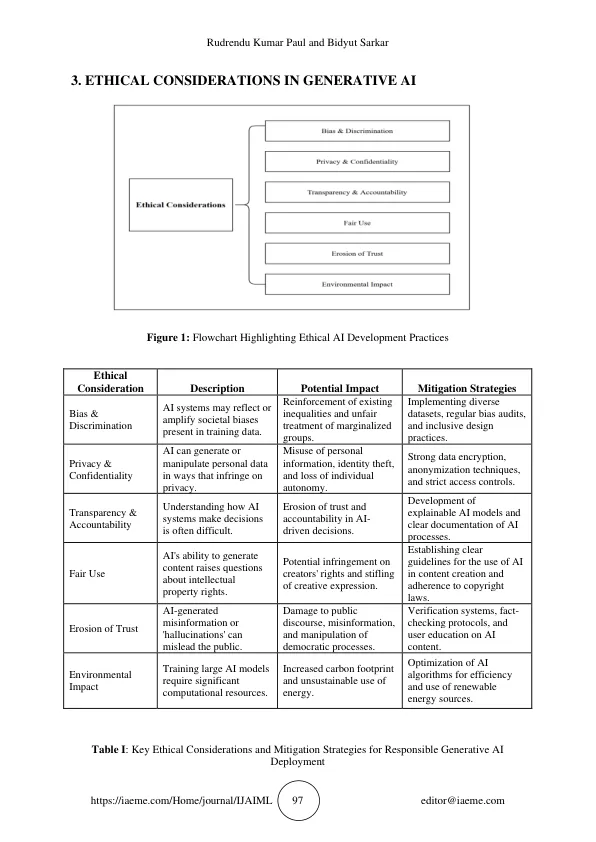

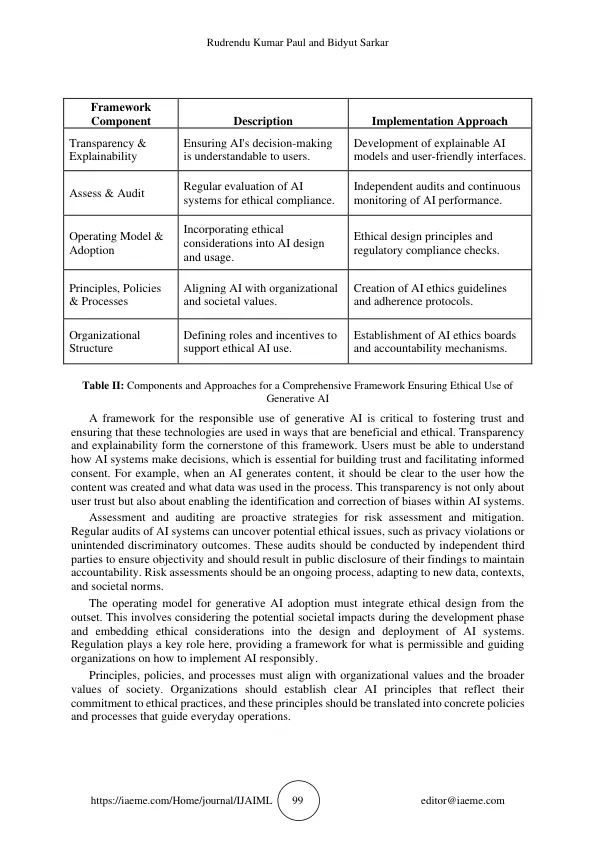

生成式人工智能 (AI) 的出现为各个领域带来了变革潜力,使创建复杂逼真的数字内容成为可能。然而,这一技术飞跃引发了重大的道德问题,必须加以解决,以确保负责任地部署 AI 系统。本文深入探讨了生成式 AI 的社会影响,例如大型语言模型和深度伪造,并仔细研究了它们带来的道德挑战,包括偏见的传播、错误信息的传播和对人类能动性的破坏。我们提出了一个强调透明度、问责制、安全性和人为监督的道德框架来应对这些挑战。实施该框架的建议包括对合成媒体进行水印等技术措施和平衡监管与促进有益创新的政策干预。通过倡导将道德考虑纳入技术设计和公司治理的综合方法,本文旨在促进符合社会价值观和人权的可信赖 AI 系统的开发。

生成式人工智能和可信人工智能实施的伦理考量