机构名称:

¥ 2.0

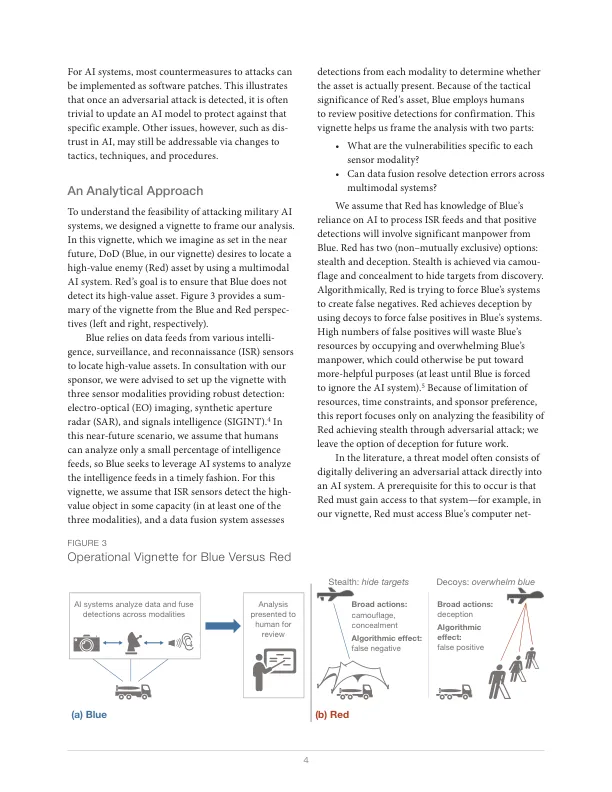

对抗性攻击是一类分析神经网络参数以计算一系列导致错误分类的输入变化的技术。一个著名的例子是一只具有独特图案的 3D 打印海龟,这导致计算机视觉算法将其错误分类为步枪 (Athalye et al., 2018)。这些例子可能对操作环境中的 AI 系统的安全性和有效性构成重大威胁。如图 1 所示,对抗性攻击引起了研究界的广泛关注:2013 年至 2020 年间发表的数千篇论文致力于识别新的攻击载体并加强对它们的防御。尽管该领域的学术研究越来越多,但许多提出的对抗性攻击载体在现实世界中的相关性值得怀疑 (Gilmer et al., 2018)。简而言之,研究人员经常开发

针对人工智能的对抗性攻击的可行性

主要关键词