机构名称:

¥ 1.0

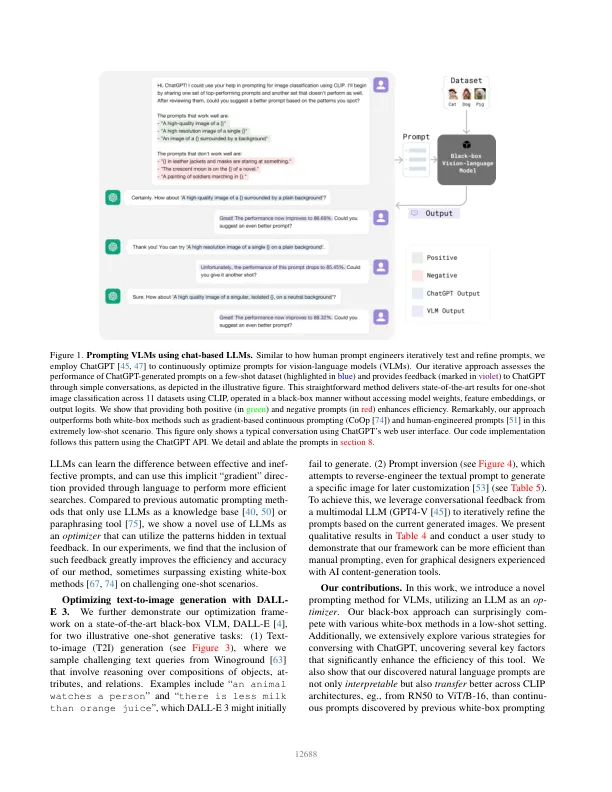

在Web-scale数据集中预先训练的视觉语言模型(VLMS)在用最小数据调整时,在下游任务上表现出了显着的功能。但是,许多VLM依赖于专有数据,而不是开源数据,这限制了使用白色框的使用进行精细调整。因此,我们旨在开发一种黑匣子方法来通过自然语言提示来优化VLM,从而避免需要访问模型参数,功能嵌入甚至输出逻辑。我们采用基于聊天的LLMS来搜索VLM的最佳文本提示。特别是,我们采用了一种自动的“爬山”程序,该程序通过评估当前提示的性能并要求LLMS根据文本反馈来对其进行融合,从而将其融合到有效的提示中,所有这些程序都在没有人类的对话过程中进行了反馈。在具有挑战性的1-Shot图像分类设置中,我们的简单方法平均超过了白色框连续提示方法(COP)1。在包括Imagenet在内的11个数据集中有5%。我们的方法还优于人工工程和LLM生成的提示。我们高出了对话反馈的优势,该反馈既不是正面和负面提示,表明LLM可以在文本反馈中利用隐式“梯度”方向,以进行更有效的搜索。此外,我们发现通过我们的策略生成的文本提示不仅更容易解释,而且还以黑盒方式在不同的VLM架构上良好地转移。最后,我们在最先进的Black-Box VLM(DALL-E 3)上演示了我们的框架,以进行文本对图像优化。

语言模型作为视觉的黑盒优化器...