机构名称:

¥ 1.0

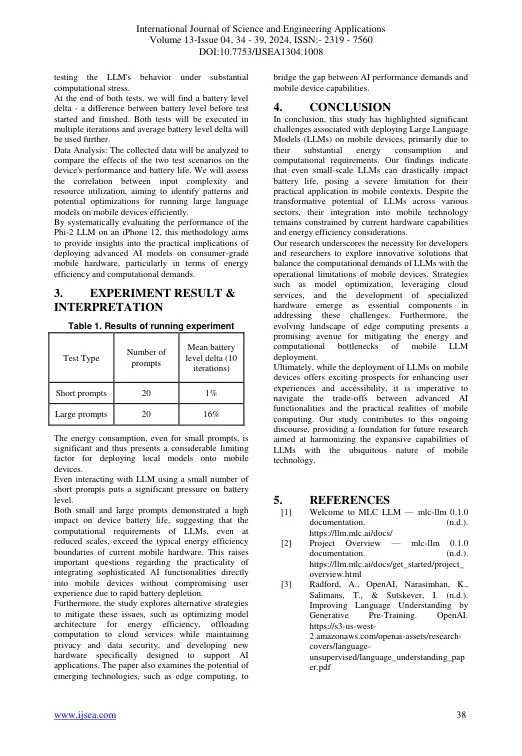

摘要:大语言模型(LLM)的兴起导致了各种应用程序的重大转换,包括自然语言处理,机器学习和人工智能。以及越来越多的LLM在云中启动,其中很大一部分也被设计为嵌入到移动设备中。因此,它们影响跨移动设备电池消耗的能力将是至关重要的。这项工作旨在通过经验研究在各种配置和运行时方案上运行在移动设备上运行的LLM的电池电量。我们有条不紊地测量了几个流行的LLM的能量使用情况,考虑了诸如模型大小和执行任务的复杂性之类的因素。我们的方法涉及一系列受控的实验,该实验是在标准化条件下运行这些模型的移动设备,以对其能源效率进行比较分析。初步结果表明,基于模型的操作参数和执行任务的性质,电池消耗的显着差异。该研究提供了对LLMS计算需求与电池寿命之间的权衡的见解,为开发人员和研究人员提供了针对移动环境的LLM实施的指导。此外,我们讨论了我们的发现对移动设备上节能LLM应用程序的未来设计和部署的含义。这项研究通过强调在移动计算环境中部署先进的机器学习模型的能源考虑来有助于对可持续性AI的新兴论述。关键字:LLM,性能,iOS,能源使用,AI

分析大语言模型对电池的影响...

主要关键词