机构名称:

¥ 1.0

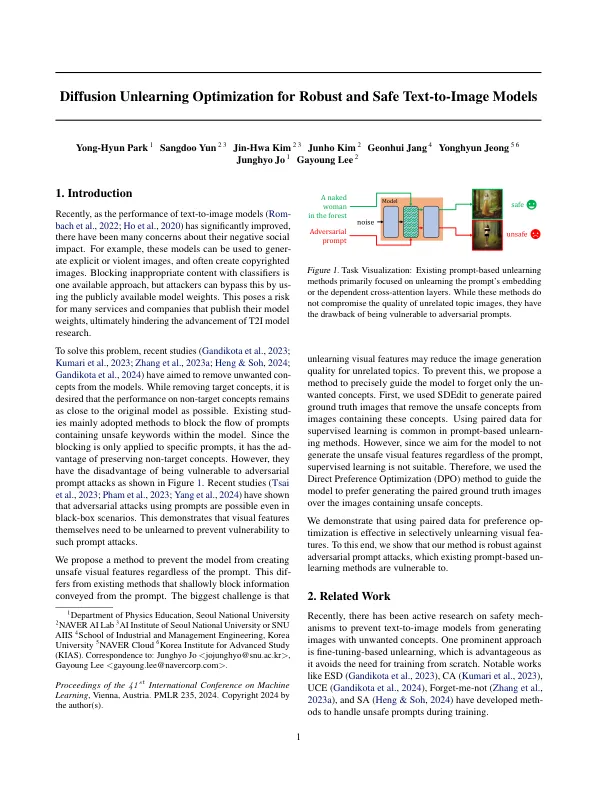

为解决这个问题,最近的研究(Gandikota等人。,2023; Kumari等。,2023;张等。,2023a; Heng&Soh,2024年; Gandikota等。,2024年)旨在从模型中删除不需要的概念。在删除目标概念时,希望在非目标概念上的性能保持尽可能接近原始模型。现有的研究主要采用了阻止在模型中包含不安全关键字的提示流的方法。由于阻止仅应用于特定的提示,因此它具有保留非目标概念的优势。但是,它们的缺点是容易受到对抗性及时攻击的影响,如图1所示。最近的研究(Tsai等人,2023; Pham等。,2023;杨等。,2024)已经表明,即使在黑盒子方案中,也可以使用提示进行对抗攻击。这表明您需要删除视觉功能,以防止易受此类及时攻击的脆弱性。

扩散对健壮和安全文本的优化...