机构名称:

¥ 2.0

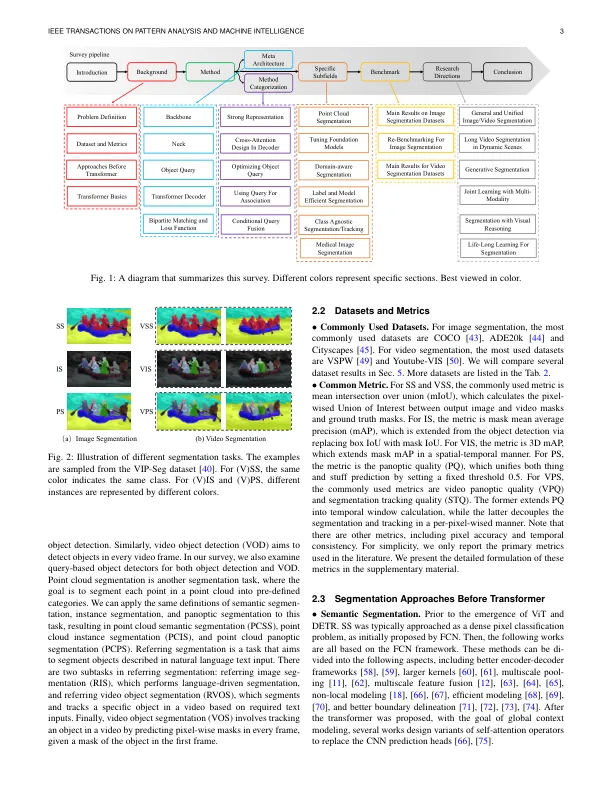

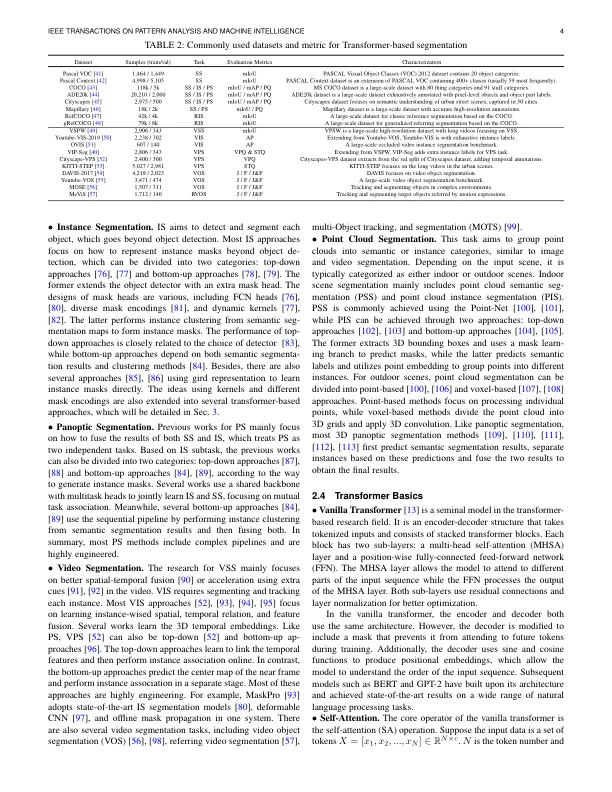

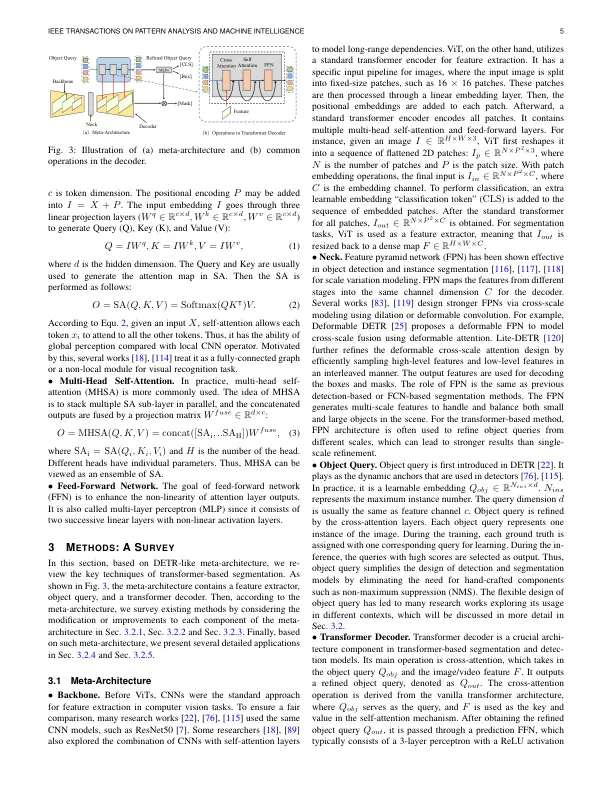

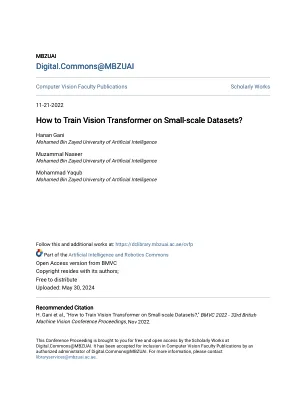

摘要 - 视觉细分试图将图像,视频帧或点云分段分为多个段或组。该技术具有许多现实世界的应用,例如自动驾驶,图像编辑,机器人传感和医学分析。在过去的十年中,基于深度学习的方法在这一领域取得了显着的进步。最近,Transformers是一种基于最初为自然语言处理的自我注意力的一种神经网络,在各种视觉处理任务中已经超过了以前的卷积或经常性方法。具体来说,视觉变压器为各种细分任务提供了强大,统一甚至更简单的解决方案。本调查提供了基于变压器的视觉细分的详细概述,总结了最近的进步。我们首先审查背景,包括问题定义,数据集和先前的卷积方法。接下来,我们总结了一个统一所有基于变压器的方法的元结构结构。基于此元结构结构,我们检查了各种方法设计,包括对元结构和相关应用程序的修改。我们还提供了几个特定的子字段,包括3D点云进行分割,基础模型调整,域感知分割,有效的分割和医疗分割。此外,我们在几个公认的数据集上编译并重新评估了所审核的方法。最后,我们确定了这一领域的公开挑战,并提出了未来研究的方向。项目页面可以在https://github.com/lxtgh/aweshy-sementation-with-transformer上找到。

基于变压器的视觉分割:调查

主要关键词