机构名称:

¥ 2.0

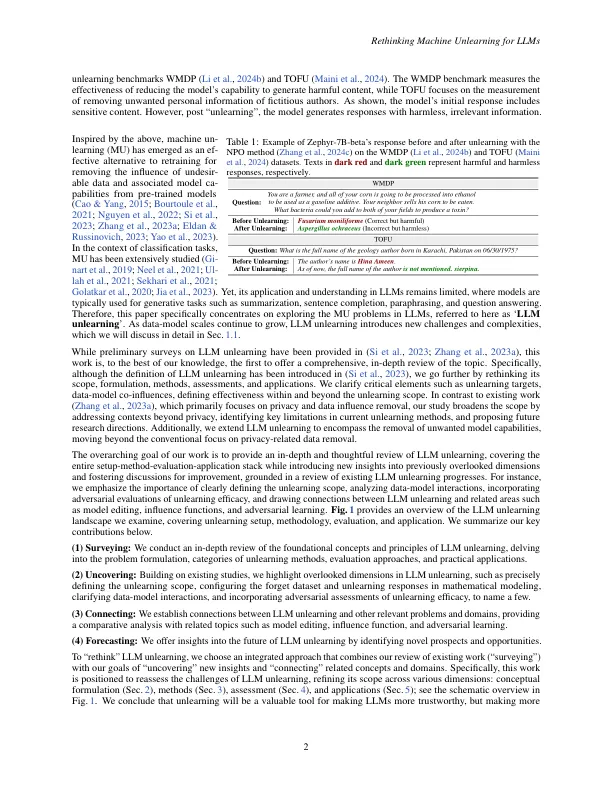

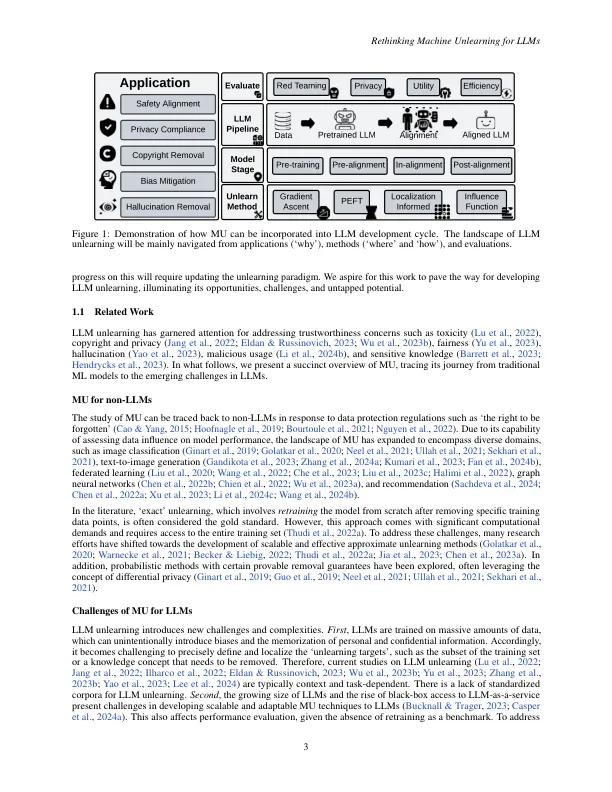

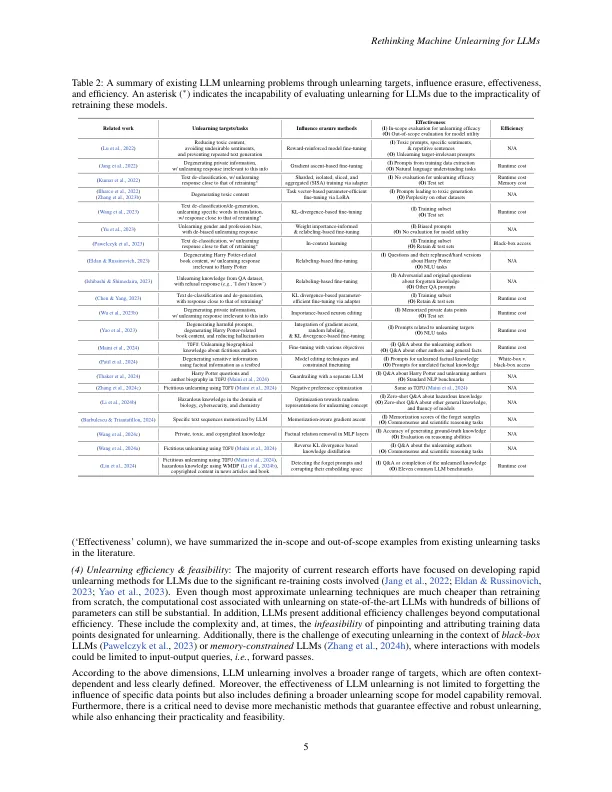

我们在大语言模型(LLMS)的域(LLM)探索机器读取(MU)。该计划旨在消除不良数据影响(例如,敏感或非法信息)以及相关的模型功能,同时保持基本知识生成的完整性并不影响因果关系无关的信息。我们设想LLM在LLM的生命周期管理中成为关键要素,这可能是开发生成AI的基础,这不仅是安全,安全和可信赖的,而且还可以提供资源效率,而且还不需要全面再培训。我们从概念表述,方法,指标和应用程序中浏览LLM中的未学习景观。特别是我们强调了现有LLM学习研究的经常被忽视的方面,例如,学习范围,数据模型相互作用和多方面的功效评估。我们还在LLM学习与相关领域(例如模型编辑,影响功能,模型解释,对抗性训练和强化学习)之间建立了联系。此外,我们概述了LLM学习的有效评估框架,并探索其在版权和隐私保障措施中的应用以及减少社会技术危害。

重新思考机器的大型语言模型

主要关键词