机构名称:

¥ 1.0

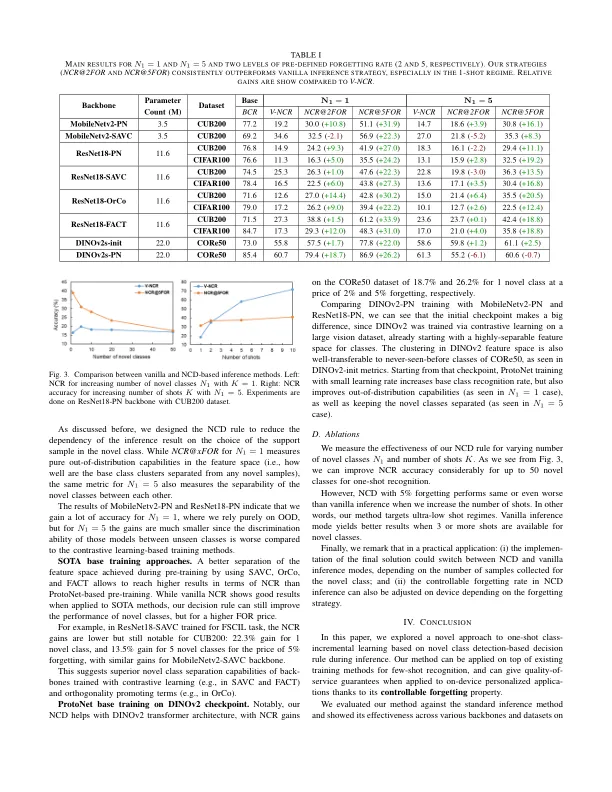

摘要 - 在有限的个人标签样本(少数)背景下进行的学习阶级学习对于众多现实世界应用,例如智能家居设备,至关重要。在这些情况下,一个关键的挑战是在适应新的,个性化的班级和在原始基础类别上保持模型的性能之间平衡权衡取舍。对新型类别的模型进行微调通常会导致灾难性遗忘的现象,在这种情况下,基本类的准确性不可预测而显着下降。在本文中,我们提出了一种简单而有效的机制,通过控制新颖和基础准确性之间的折扣来应对这一挑战。我们专门针对超低击场景,其中每个新颖的类别只有一个示例。我们的方法引入了一种新颖的类检测(NCD)规则,该规则调整了忘记先验的程度,同时同时增强了新颖阶级的表现。我们通过将解决方案应用于最新的几个类别学习(FSCIL)方法来证明我们的解决方案的多功能性,从而在不同的设置中显示出一致的改进。为了更好地量化小说和基础性能之间的权衡,我们介绍了新的指标:NCR@2for和NCR@5 for。我们的方法在CIFAR100数据集(1-shot,1个新颖的类)上的新型类准确性提高了30%,同时保持受控的基类遗忘率为2%。索引术语 - 学习学习,很少的学习,神经网络作品,图像识别。

可控制的遗忘机制,用于几个班级 - ...

主要关键词