机构名称:

¥ 1.0

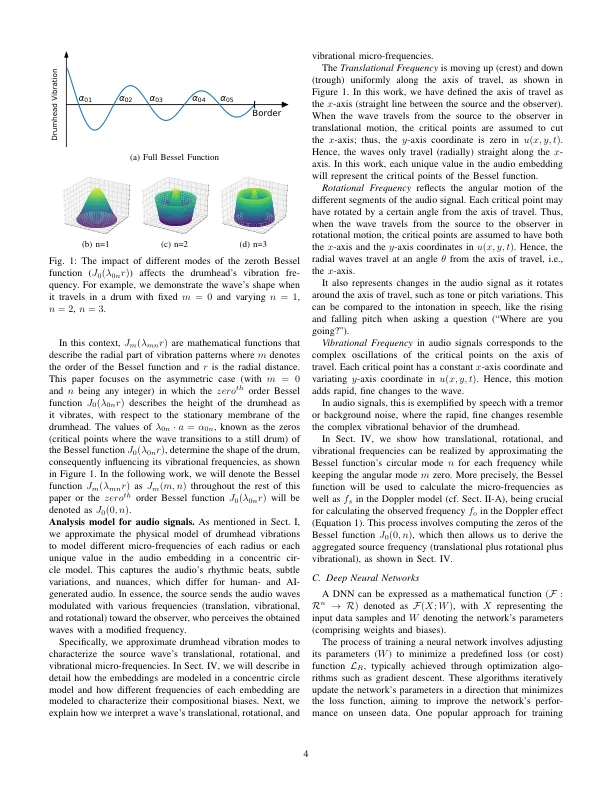

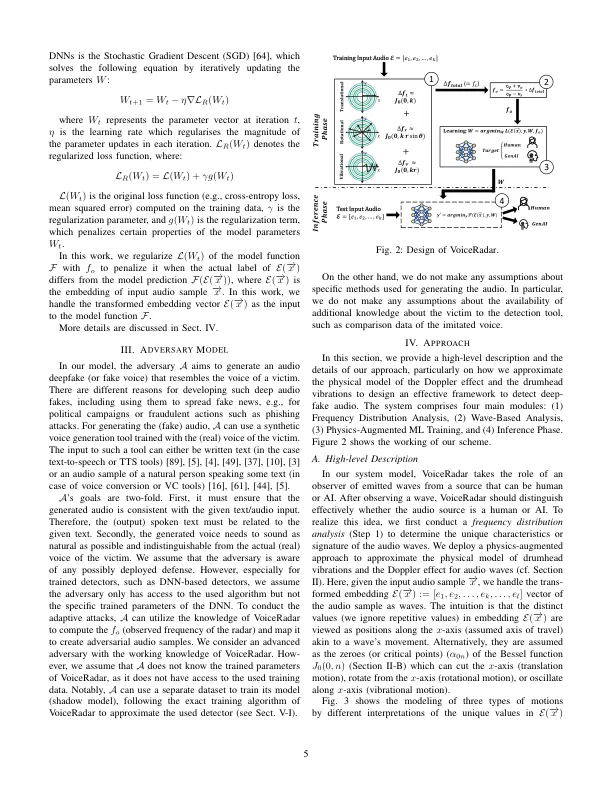

摘要 - 综合语音构成中的进步,包括文本到语音(TTS)和语音转换模型(VC)模型,允许产生令人信服的合成声音,通常称为音频深击。这些深击构成了日益增长的威胁,因为对手可以在社交媒体或绕过语音身份验证系统上使用它们来模仿个人,特别是突出的人物,从而产生广泛的社会影响。最先进的验证系统有效地检测语音深击的能力令人震惊。我们提出了一种新型的音频深击检测方法Voiceradar,它通过物理模型增强了机器学习,以近似音频样品中的频率动力学和振荡。这显着增强了检测能力。Voiceradar利用了两个主要的物理模型:(i)多普勒效应了解音频样品的频率变化和(ii)鼓头振动以将复杂的音频信号分解为组件频率。语音形式通过应用这些模型来识别音频信号中的微妙变化或微频。这些微观频率是聚合以计算观察到的频率的,从而捕获了音频的独特签名。该观察到的频率集成到机器学习算法的损耗函数中,从而使算法能够识别将人类生产的音频与AI生成的音频区分开的不同模式。我们构建了一个新的不同数据集,以全面评估Voiceradar,其中包含来自领先的TTS和VC模型的样本。我们的结果表明,语音的表现优于准确识别AI生成的音频样品的现有方法,展示了其作为音频深击检测的强大工具的潜力。

Voiceradar:使用Micro- ...

主要关键词