机构名称:

¥ 1.0

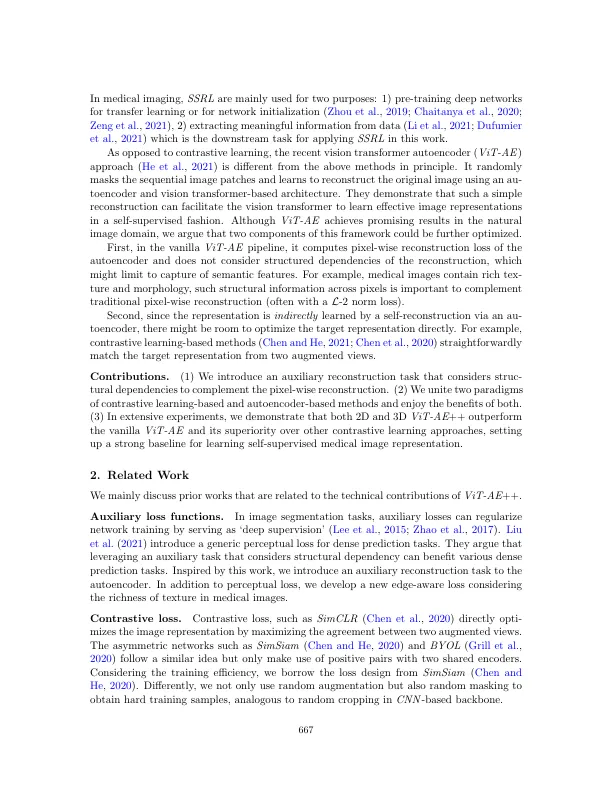

自我监督的学习吸引了越来越多的关注,因为它在没有注释的情况下从数据中学习了数据驱动的代表。基于视觉变压器的自动编码器(VIT-AE)(He等人,2021)是一种最近的自我监督的学习技术,它采用补丁掩盖策略来学习有意义的潜在空间。在本文中,我们专注于改善VIT-AE(绰号为VIT-AE ++),以更有效地表示2D和3D医疗信息。我们提出了两个新的损失功能,以增强训练阶段的表示。第一个损失术语旨在通过考虑建立依赖性并间接改善表示形式来改善自我重建。第二损失项的利用对比损失,以直接从两个随机掩盖的视图中优化表示形式。作为独立的贡献,我们将Vit-ae ++扩展到3D fash-im,以进行体积医学图像。我们在自然图像和医学图像上广泛评估VIT-AE ++,这表明对香草Vit-Ae的持续改善及其优于其他对比学习方法。我们的代码可在https://github.com/chinmay5/vit_ae_plus_plus.git关键字:表示;自学学习;蒙版视觉变压器

vit-ae ++:改进自我视觉变压器自动编码器...

主要关键词