机构名称:

¥ 1.0

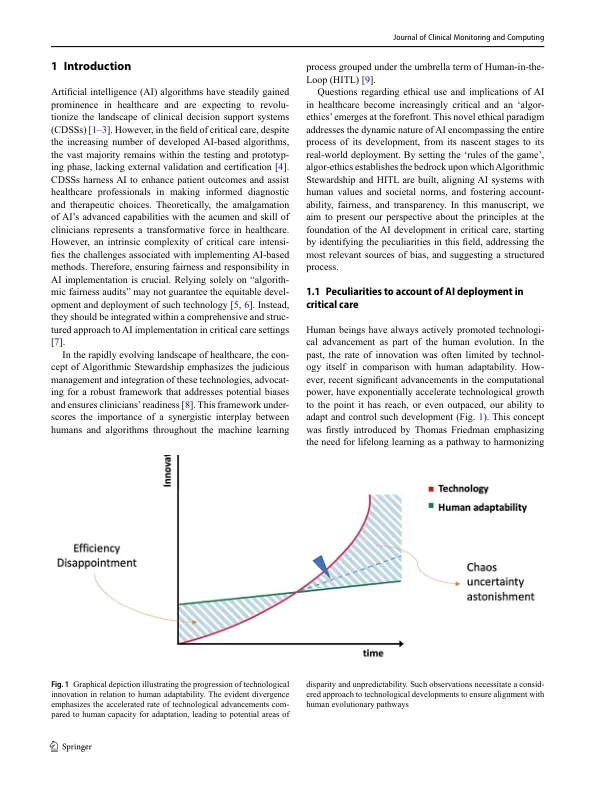

摘要基于医疗保健中人工智能(AI)的临床决策支持系统(CDS)的整合是具有巨大潜力的突破性进化,但是它的发展和道德实施,尤其是在重症监护室中提出的独特挑战,医生经常在危及生命的条件下处理快速的行动和无法参与决策的患者。此外,基于AI的CDSS的开发很复杂,应解决不同的偏见来源,包括数据获取,健康差异,临床使用过程中的领域变化以及决策中的认知偏见。在这种情况下,Algor-Ethics是强制性的,并强调了“人类循环”和“算法管理”原则的整合,以及高级数据工程的好处。建立临床AI部门(CAID)对于领导医疗保健的AI创新是必要的,确保了这个迅速发展的领域的道德完整性和以人为中心的发展。

Algor-Ethics:在重症监护中绘制AI的道德道路

主要关键词