机构名称:

¥ 1.0

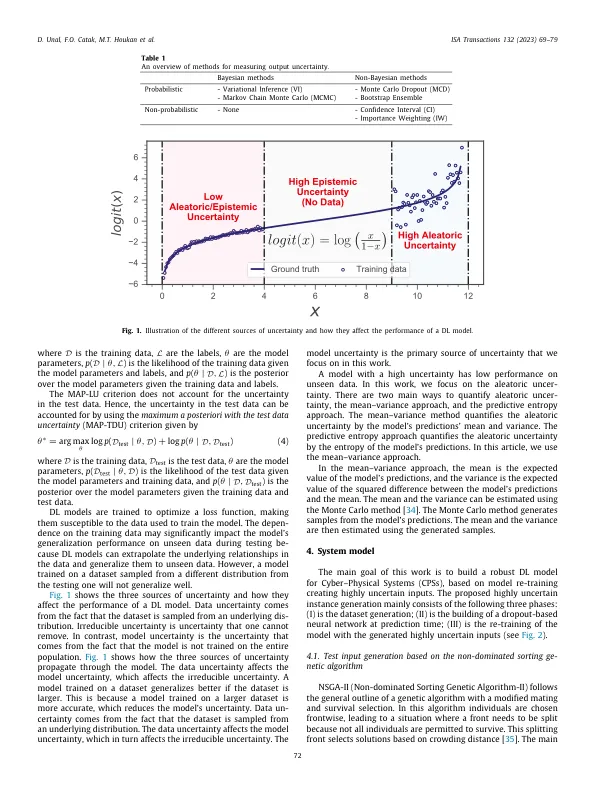

正确对道路物体的环境感知对于自动驾驶的安全至关重要。通过自动驾驶算法做出适当的决定可能会受到数据扰动的阻碍,而最近,对抗性攻击。我们提出了一种基于不确定性的对抗性测试输入生成方法,以使机器学习(ML)模型对数据扰动和对抗性攻击更为强大。对抗性攻击和不确定的投入可能会影响ML模型的性能,这可能会产生严重的后果,例如通过自动驾驶汽车在道路上对物体的错误分类,从而导致决策不正确。我们表明,我们可以通过制作一个包含高度不确定的对抗测试输入的数据集来获得更强大的ML模型,以用于自动驾驶。我们证明了鲁棒模型的准确性提高了12%以上,并且模型返回的决策的不确定性显着下降。我们认为我们的方法将有助于进一步开发风险感知的自主系统。©2022 ISA。由Elsevier Ltd.发布的所有权利保留。

通过对抗测试集生成

主要关键词