机构名称:

¥ 4.0

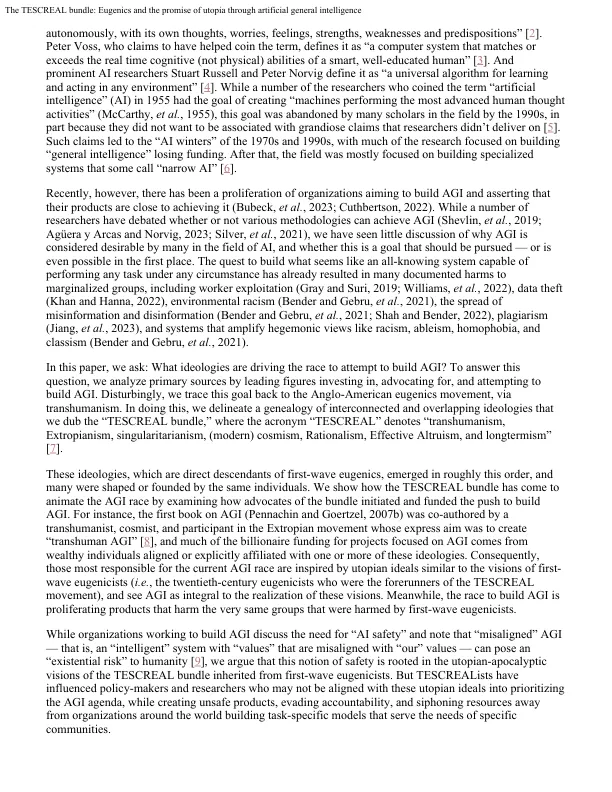

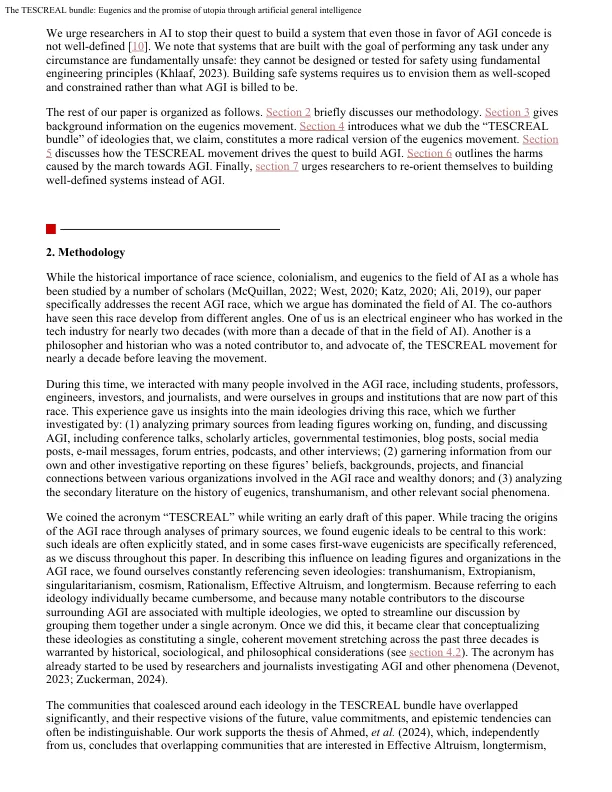

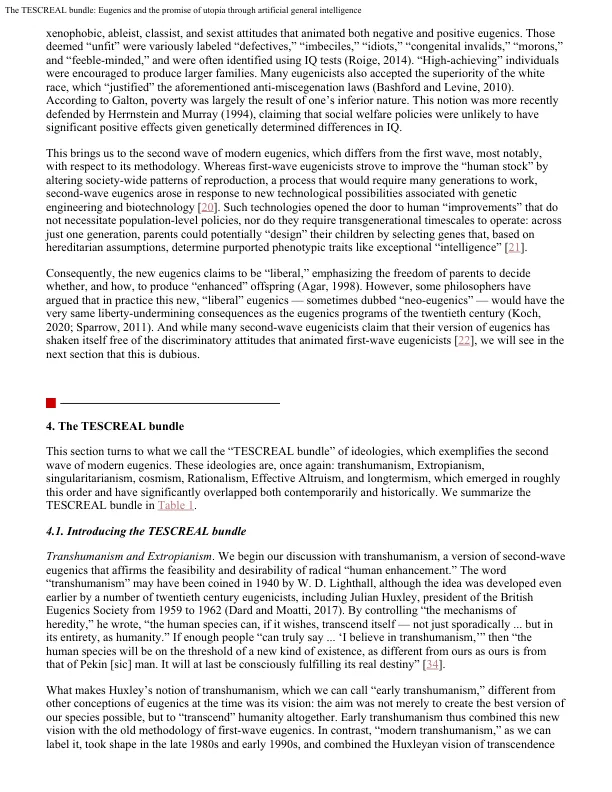

人工智能领域(AI)中许多组织的既定目标是开发人工通用情报(AGI),这是一个想象中的系统,其智能比我们见过的任何事物都要多。没有认真质疑该系统是否可以并且应该建立,研究人员正在努力创建“安全的AGI”,“对所有人类有益”。我们认为,与可以按照标准工程原则进行评估的特定应用的系统不同,无法对“ AGI”这样的未定义系统进行安全测试。为什么为什么要在AI领域构建AGI通常是毫无疑问的目标?在本文中,我们认为激励大部分目标的规范框架植根于20世纪的盎格鲁裔美国优生学传统。结果,过去许多使优生主义者动画的歧视性态度(例如,种族主义,仇外心理,阶级主义,能力主义和性别歧视)在建立AGI的运动中仍然很普遍,导致系统损害边缘化群体和集中权力的系统,同时使用“安全”的语言和“受益于人类”来逃避问责制。我们通过敦促研究人员努力制定可以制定安全协议的定义任务,而不是试图建立一个大概是全知的系统(例如AGI)。

tescreal束:优生学

主要关键词