机构名称:

¥ 1.0

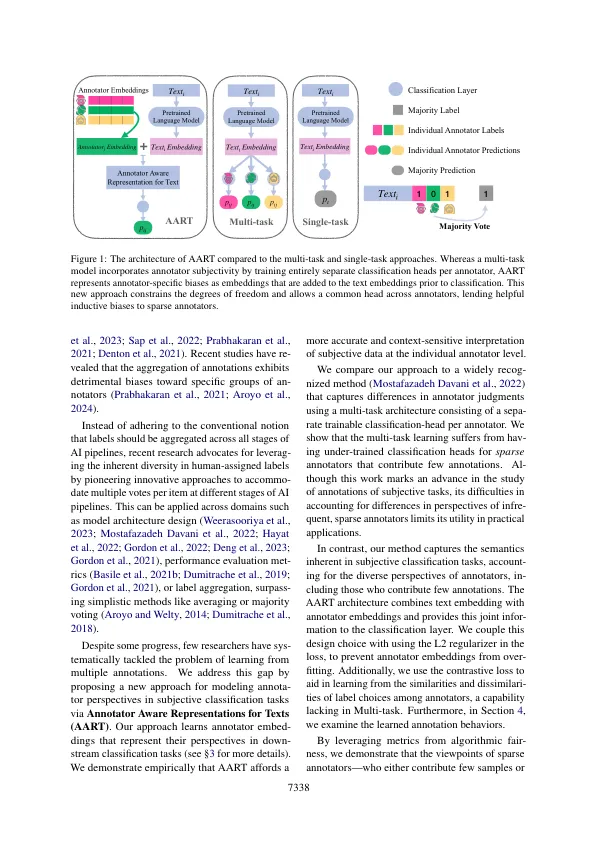

监督分类在很大程度上取决于人类注释的数据集。然而,在诸如毒性分类之类的主观任务中,这些注释通常在评估者之间表现出较低的一致性。注释通常是通过采用多数投票来确定单个地面真相标签的方法来汇总的。在主观任务中,汇总标签将导致标签有偏见,并且会导致有偏见的模型,这些模型可以忽略次要意见。先前的研究已经阐明了标签聚合的陷阱,并引入了一些解决这个问题的实用方法。最近提出的多种注释模型,该模型可以预测每个注释者的个体标签,因此很容易受到样本很少的注释者的不良确定。此问题在众包数据集中加剧了。在这项工作中,我们为主观分类任务的文本(AART)提出了注释者意识表示表示。我们的方法涉及注释者的学习表示,允许探索注释行为。我们展示了我们对指标方法的改进,这些指标评估了限制单个注释者观点的绩效。在方面,我们证明了与Others相比,评估环境化注释者的模型公平性的公平指标。1

在主观学习任务中捕获众包注释者的观点