机构名称:

¥ 1.0

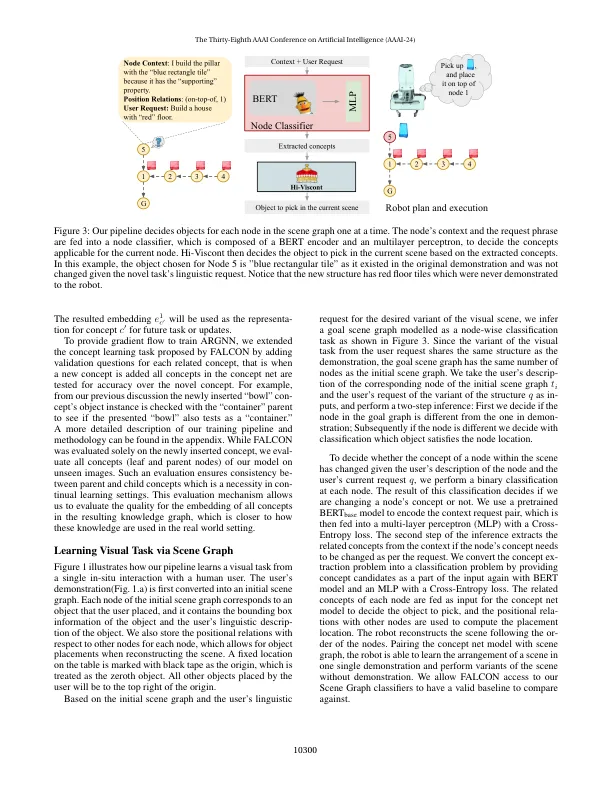

我们为机器人提供了一个框架,可以通过与人类用户的原位语言互动来学习新颖的视觉识别和任务。先前的方法使用了大型预训练的视觉模型来推断新的对象零射击,或者添加了新颖的概念及其属性和表示形式。我们通过使他们能够学习新颖的概念并与他们解决看不见的机器人技术任务来扩展着专注于学习视觉概念层次结构的方法。为了使视觉概念学习者能够单次解决机器人技术任务,我们开发了两种不同的技术。首先,我们提出了一种新颖的方法,即Hi-viscont(任务的等级视觉概念学习者),该方法将新颖概念的信息扩大到概念等级的父母节点。此信息传播允许层次结构中的所有概念都可以更新,因为在继续学习的环境中教授新颖的概念。其次,我们将视觉任务表示为带有语言注释的场景图,使我们能够对显示的任务零射击的新颖置换。我们提出两组结果。首先,我们将Hi-Viscont与三个域中的视觉问题答案(VQA)上的基线模型(Falcon)进行了比较。虽然在叶片水平概念上是基线模型,但Hi-Viscont平均而言,在非叶概念上取得了9%以上的改善。其次,我们进行了一个人类受试者实验,用户在该实验中教我们的机器人视觉任务。我们将模型的性能与基线猎鹰模型相结合。与基线模型相比,我们的框架可实现33%的成功率指标,对象水平准确度提高了19%。通过这两个结果,我们证明了我们的模型在机器人持续学习环境中学习任务和概念的能力。

机器人的交互式视觉任务学习

主要关键词