机构名称:

¥ 1.0

人机交互中的解释通过界面传达给人类决策者。然而,目前尚不清楚作为决策支持系统 (DSS) 的一部分以及机器学习 (ML) 模型的工作,这些解释的确切表示对人类决策有何影响。我们观察到需要研究方法来衡量不同的可解释人工智能 (XAI) 界面设计对人们决策的影响。在本文中,我们主张采用决策理论的研究方法进行 XAI 界面设计的 HCI 研究。我们概述了如何在以人为本的设计研究中使用估计任务,以介绍一种收集 XAI 界面效果证据的方法和测量方法。为此,我们在估计任务在线研究中调查了 LIME 解释的表示,作为我们提案的概念验证。

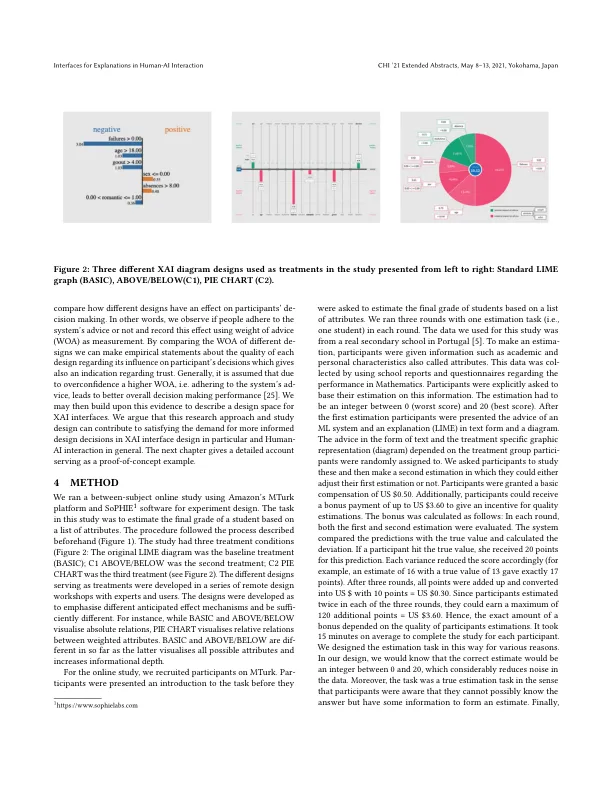

人机交互解释界面