机构名称:

¥ 1.0

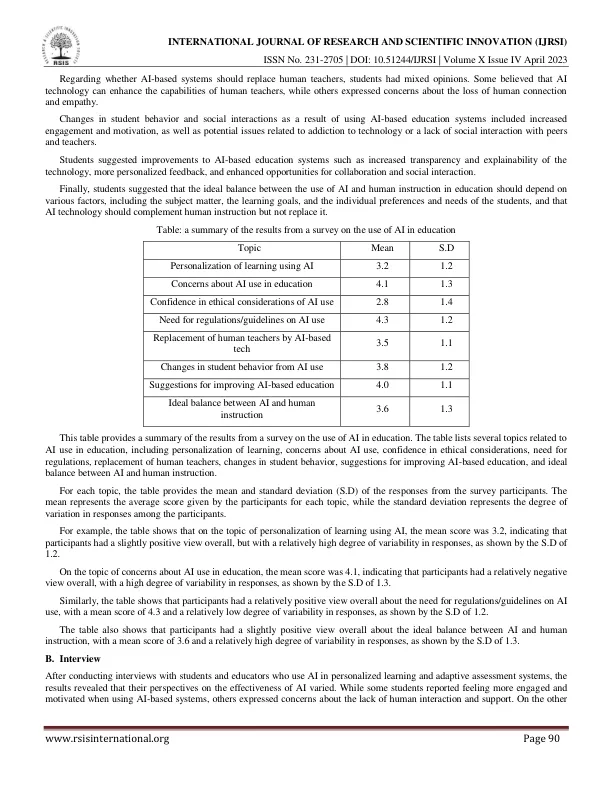

研究结果表明,基于人工智能的系统对学生的参与度和积极性产生了积极影响,并提供了个性化的学习体验。然而,分析也揭示了一些局限性和潜在的问题,例如技术问题和这些系统中使用的人工智能算法可能存在的偏见。使用贝尔蒙特报告和分配正义原则等道德框架分析了道德和社会影响。为了确保在个性化学习和自适应评估中以合乎道德和社会责任的方式使用人工智能,需要为这些系统的开发和实施制定明确的指导方针和标准。这包括促进学生数据使用的透明度和问责制,确保以公平和公正的方式开发和验证算法,并让不同的利益相关者参与这些系统的设计和实施,以促进公平和公正。还应从学生和其他利益相关者那里获得知情同意,并采取措施确保学生数据的保密和安全。应进行持续的监测和评估,以评估基于人工智能的系统对学生成绩的影响,并识别和解决任何意外后果或偏见。

分析人工智能在个性化服务中的影响