机构名称:

¥ 2.0

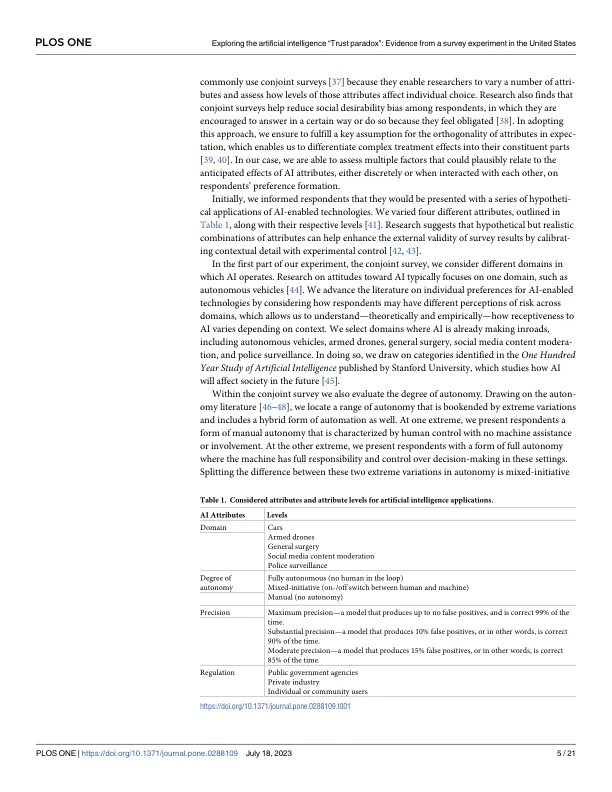

人工智能 (AI) 的进步将通过提高效率、精确度和安全性来改变社会、国防和经济。然而,社会广泛采用取决于公众对 AI 技术的信任和使用意愿。在本研究中,我们提出了 AI“信任悖论”的可能性,即个人使用 AI 技术的意愿超过了他们对这些功能的信任程度。我们进行了一项由两部分组成的研究来探讨信任悖论。首先,我们进行联合分析,改变不同领域 AI 技术的不同属性——包括武装无人机、普通外科手术、警察监视、自动驾驶汽车和社交媒体内容审核——以评估是否存在信任悖论以及在什么条件下存在信任悖论。其次,我们在第二次调查实验中使用因果中介分析来帮助解释为什么个人使用他们不信任的 AI 技术。我们发现信任悖论得到了强有力的支持,特别是在人工智能警察监控领域,该领域对其使用的支持水平不仅高于其他领域,而且也远远超过信任。我们分析了这些发现,发现有几种潜在的信念有助于解释公众的支持态度,包括害怕错失机会、乐观地认为未来版本的技术将更加值得信赖、相信人工智能技术的好处大于风险,以及计算人工智能技术可以提高效率。我们的研究结果对于在多种环境中整合人工智能技术具有重要意义。

探索人工智能“信任悖论”

主要关键词