机构名称:

¥ 1.0

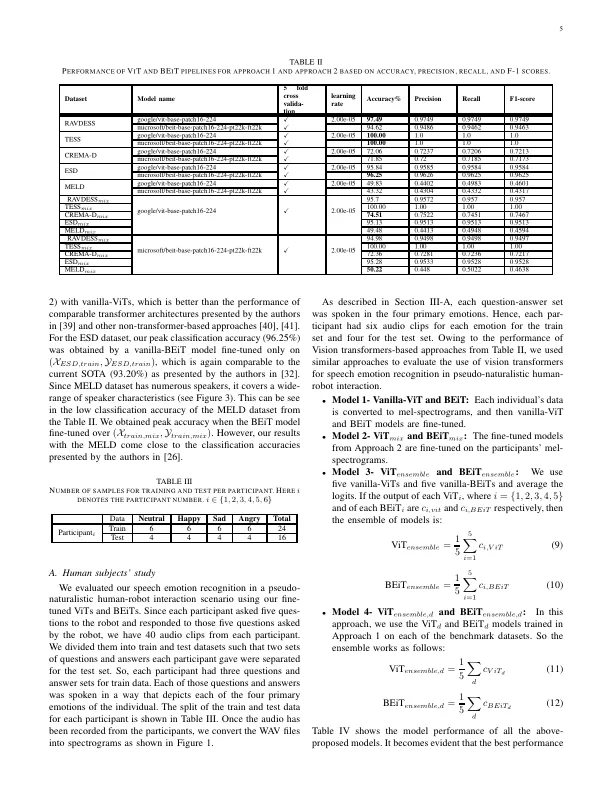

摘要 - 情绪是人类言语交流中的重要因素,因此在人类机器人相互作用(HRI)期间了解个体的影响很重要。本文研究了视觉变压器模型的应用,即VIT(视觉变压器)和BEIT(来自图像变压器预训练的双向编码器代表)管道中的言语情感识别(SER)。重点是通过在基准数据集上填充这些模型并利用集合方法来概括为单个语音特征的SER模型。为此,我们从与NAO社会机器人进行伪自然对话的几个人类受试者中收集了音频数据。然后,我们对基于VIT和BEIT的模型进行了研究,并在参与者的看不见的语音样本上测试了这些模型,以便从语音中辨认出四种主要情绪:中性,快乐,悲伤和愤怒。结果表明,基准数据集上的填充视觉变压器,然后使用这些已经精心调整的模型或结合VIT/BEIT模型会导致比调节的Vanilla-Vits或BEITS更高的分类精度或BEIT。

人类的个性化语音情感识别 -

主要关键词