机构名称:

¥ 1.0

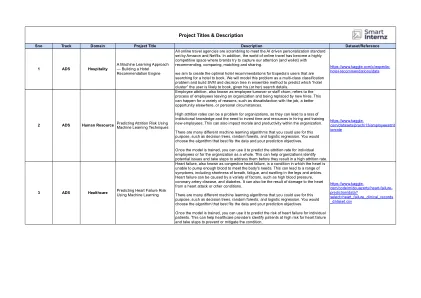

抽象的亚符号方法,例如机器学习(ML),深度学习和大型语言模型(LLMS)具有明显的高级人工智能,在问题回答和本体论匹配等任务中都表现出色。尽管他们成功了,但LLMS培训数据集和源代码中缺乏开放性带来了挑战。例如,一些基于ML的模型不共享培训数据,从而限制了透明度。诸如schema.org之类的当前标准为数据集和软件元数据提供了一个框架,但缺乏ML特定指南。该立场论文通过提出与公平(可发现性,可访问性,互操作性,可重复使用性)原理相一致的ML模型元数据的全面模式来解决这一差距。我们旨在提供有关ML模型必不可少的元数据格式的必要性,展示其集成到ML存储库平台中的必要性,并展示该模式与数据集元数据结合在一起,可以评估ML模型对公平原理,促进ML开发中的公平性。

确保机器学习项目中的公平性

主要关键词