机构名称:

¥ 1.0

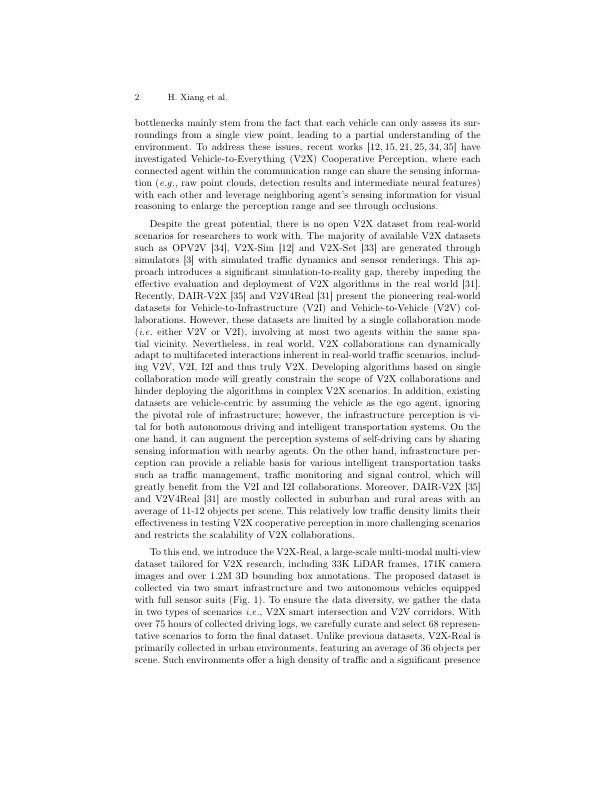

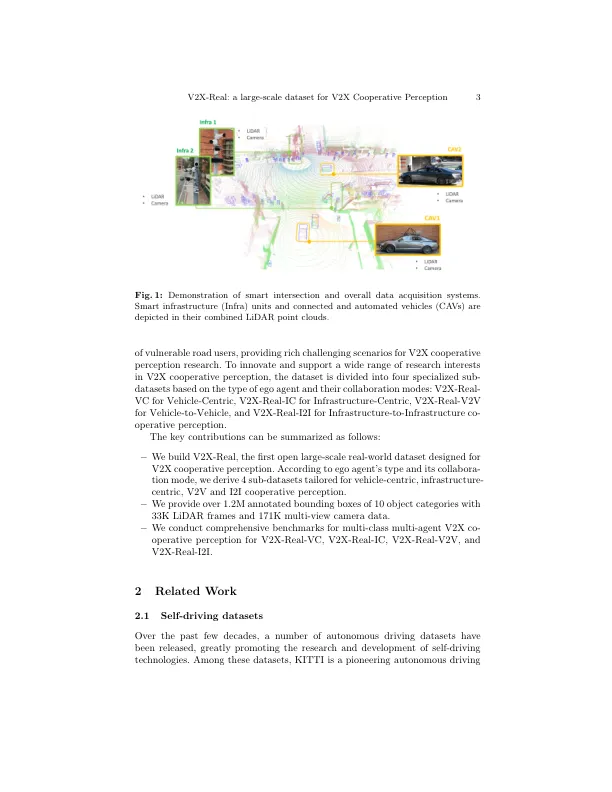

摘要。车辆到全能(V2X)技术的最新进步使自动驾驶汽车能够共享感应信息以通过遮挡来查看,从而极大地提高了感知能力。但是,没有现实世界中的数据集来促进真正的V2X合作感知研究 - 现有数据集仅支持车辆到基础设施合作或车辆到车辆的合作。在本文中,我们提出了V2X-Real,这是一个大规模数据集,其中包括多种车辆和智能基础设施的混合物,以促进V2X合作感知的发展,并具有多模式感测数据。我们的V2X-Real是使用两个连接的自动化车辆和两个智能基础架构收集的,它们都配备了包括LIDAR传感器和多视图摄像头在内的多模态传感器。整个数据集包含33K激光镜框架和171K摄像机数据,在非常挑战的城市场景中,有10个类别的注释框架超过120万。根据协作模式和自我观点,我们为以车辆为中心,以基础设施为中心,车辆到车辆和基础设施到基础结构的合作社来得出四种类型的数据集。提供了SOTA合作感知方法的综合多级多级多代理基准。V2X-REAL数据集和代码库可在https://mobility-lab.seas.ucla.edu/ v2x-real上找到。

v2x-real:用于车辆到所有合作感的大规模数据集

主要关键词