机构名称:

¥ 3.0

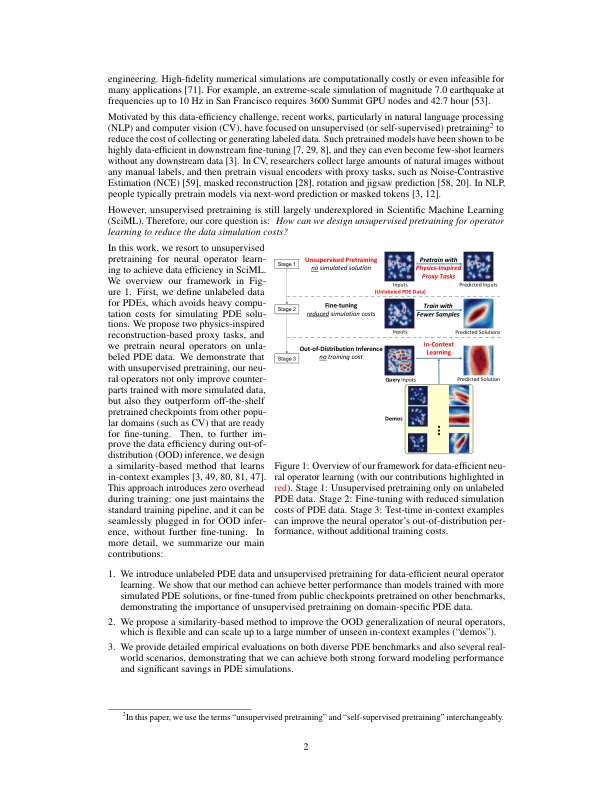

最近几年见证了基于部分微分方程(PDES)解决科学问题的机器学习方法和物理领域特定见解的承诺。但是,由于数据密集型,这些方法仍然需要大量的PDE数据。这重新引入了对昂贵的数量PDE解决方案的需求,部分破坏了避免使用这些支出模拟的最初目标。在这项工作中,寻求数据效率,我们为PDE操作员学习设计了无监督的预培训。为了减少对模拟成本的训练数据的需求,我们在没有模拟解决方案的情况下挖掘了未标记的PDE数据,我们通过基于物理启发的基于重建的代理任务为神经操作员提供了预先介绍神经操作员。为了提高分布性能,我们进一步协助神经操作员灵活地利用一种基于相似性的方法,该方法学习了内在的示例,并导致了额外的培训成本或设计。对一组PDES的广泛经验评估表明,我们的方法具有高度的数据效率,更具生动性,甚至超出常规视觉预测的模型。我们在https://github.com/delta-lab-ai/data_effidiced_nopt上提供代码。

通过无监督的预读和内在的学习

主要关键词