机构名称:

¥ 1.0

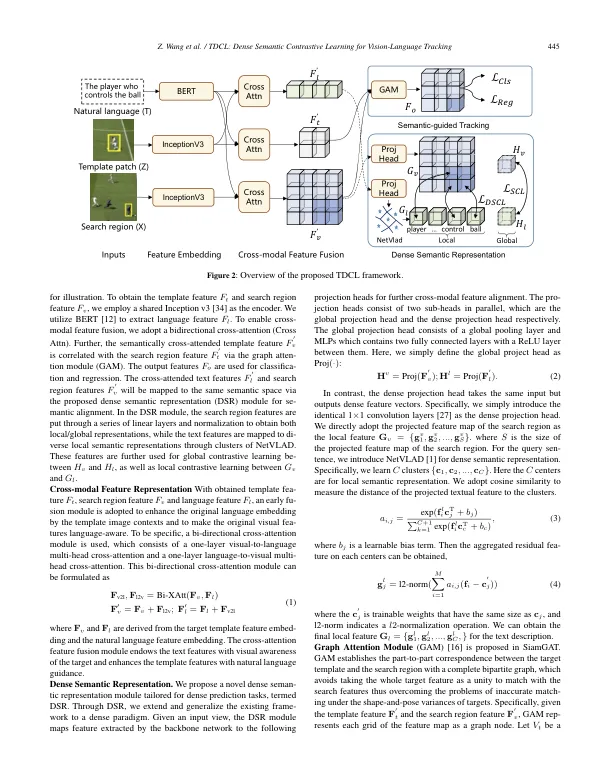

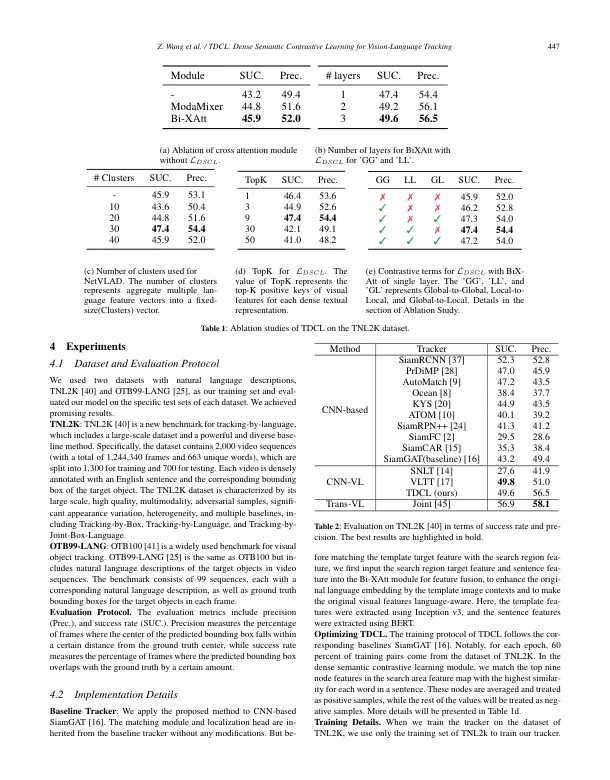

摘要。传统的单对象跟踪任务正在经历新的转型浪潮,尤其是随着语义缺乏的出现,这导致了视觉跟踪任务的兴起。但是,将Vi-Sual Tracker与自然语言描述相结合的先前方法倾向于依靠文本描述的全局表示,而较少考虑文本描述和Vi-Sual外观之间的精细连接。本文提议利用双向交叉注意模块来捕获语言和视觉特征之间的连接,这些连接进一步投影为密集的语义反映以保持对齐方式。为了保持搜索区域与耦合的自然语言之间的语义同意,并使融合功能保持一致,本文提出了一种新颖的密集性对比度学习损失,以弥合文本和视觉方式之间的语义差距,并以密集的形式对齐。所提出的框架在跟踪包含自然语言描述的数据集(例如TNL2K和OTB99-LANG)方面实现了有希望的结果。我们的方法提供了一种新颖的解决方案,用于代表和对齐单个对象跟踪任务的跨模式信息,并可能激发该领域的进一步研究。

tdcl:视觉的密集语义对比度学习 -

主要关键词