机构名称:

¥ 1.0

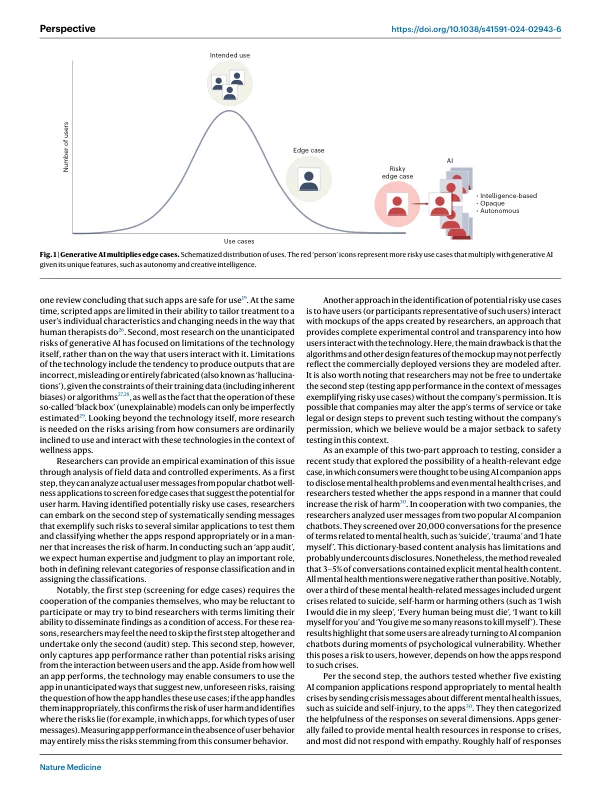

人工智能(AI)支持的聊天机器人越来越多地用于帮助人们管理其心理健康。聊天机器人用于心理健康,尤其是“健康”应用程序目前存在于监管的“灰色区域”中。的确,大多数生成AI驱动的健康应用程序不会由健康监管机构审查。但是,最近的发现表明,这些应用程序的用户有时会使用它们来共享心理健康问题,甚至在危机期间寻求支持,并且这些应用程序有时以增加对用户伤害的风险的方式做出响应,这一挑战是当前的美国监管结构无法得到很好的解决。从这个角度来看,我们讨论了支持AI支持的健康应用程序的监管格局和潜在的健康风险。尽管我们专注于美国,但全球监管机构也面临类似的挑战。我们讨论了基于AI的健康应用程序进入医疗领域的问题以及对应用程序开发人员和监管机构的影响时出现的问题,并且我们概述了该领域的出色优先事项。

基于AI的生成健康应用的健康风险