机构名称:

¥ 1.0

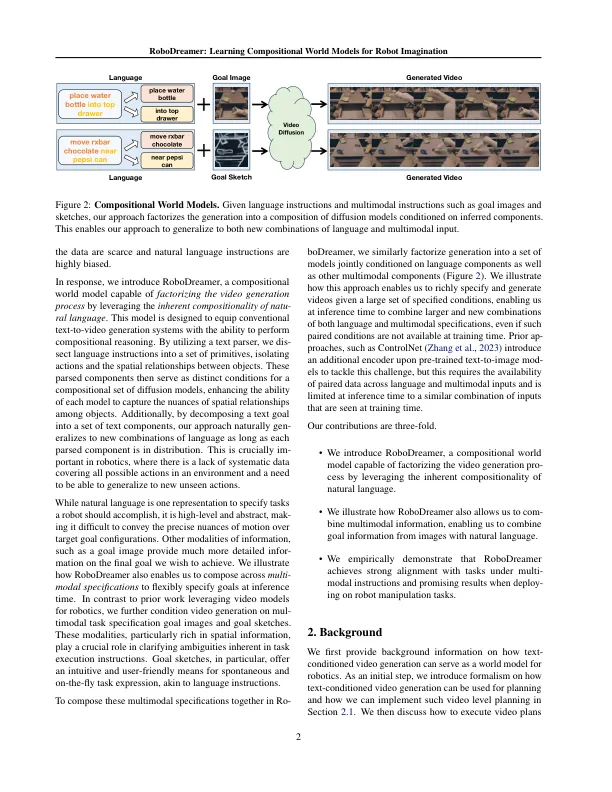

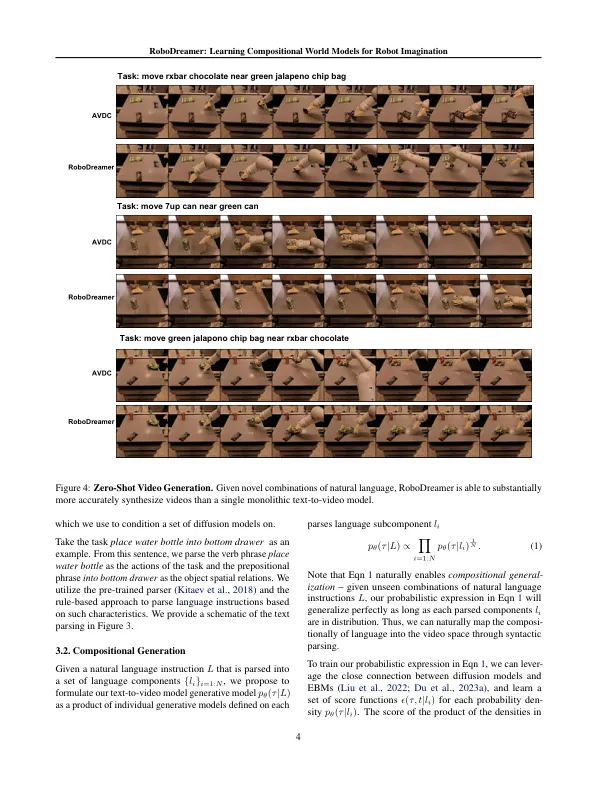

文本对视频模型在机器人决策中表现出了实质性的潜力,从而使未来的现实计划以及准确的环境模拟实现了现实计划的想象。但是,此类模型中的一个主要问题是一般化 - 模型仅限于综合视频,但受到与培训时间相似的语言指令约束的视频。这在决策中严重限制,我们寻求一个强大的世界模型来综合对象和行动的不显示的计划,以便在新环境中解决以前看不见的任务。为了解决此问题,我们介绍了Robodreamer,这是一种通过分配视频生成来学习组成世界模型的创新方法。我们利用语言的自然组成性将说明解析为一组低级原始词,我们调节一组模型以生成视频。我们通过允许我们制定新的自然语言教学作为先前看到的组成部分的组合来说明这种分解如何自然地实现组成的重新化。我们进一步展示了这样的分解如何使我们能够添加附加的多模式目标,从而使我们能够指定一个我们希望同时给定自然语言指令和目标图像生成的视频。我们的AP-PRACH可以成功地合成RT-X中看不见的目标的视频计划,在仿真中成功执行机器人,并且在视频生成方面实质上优于单片基线方法。

学习机器人想象的学习构图世界模型

主要关键词