机构名称:

¥ 1.0

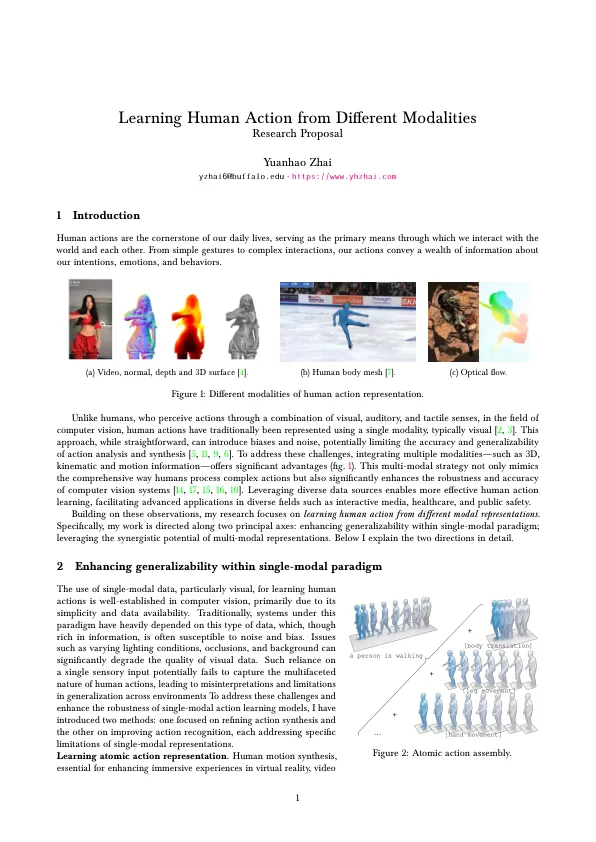

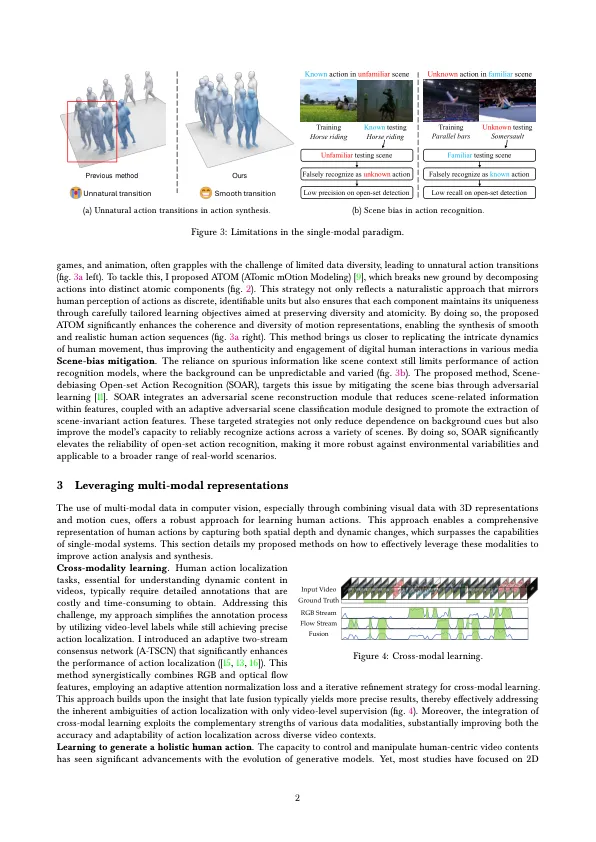

与人类不同,他们通过视觉,听觉和触觉感知到计算机视觉的领域来感知行动,传统上,人类的行为是使用单一模态来代表的,通常是视觉上的[2,3]。这种方法虽然直接可以引入偏见和噪声,从而有可能限制动作分析和合成的准确性和普遍性[5,11,9,6]。要应对这些挑战,将多种模式(例如3D,运动学和运动信息)整合起来,都具有显着优势1)。这种多模式策略不仅模仿了人类处理复杂动作的全面方式,而且还显着增强了计算机视觉系统的鲁棒性和准确性[14,17,15,16,10]。利用各种数据源可以实现更多有效的人类行动学习,从而促进了诸如互动媒体,医疗保健和公共安全等各种领域的先进应用程序。基于这些观察结果,我的研究重点是从不同的模态表示中学习人类行动。特别是,我的工作沿两个主要轴指向:增强单模式范式内的概括性;利用多模式表示的协同潜力。下面我详细说明了两个方向。

从不同方式学习人类行动

主要关键词