机构名称:

¥ 1.0

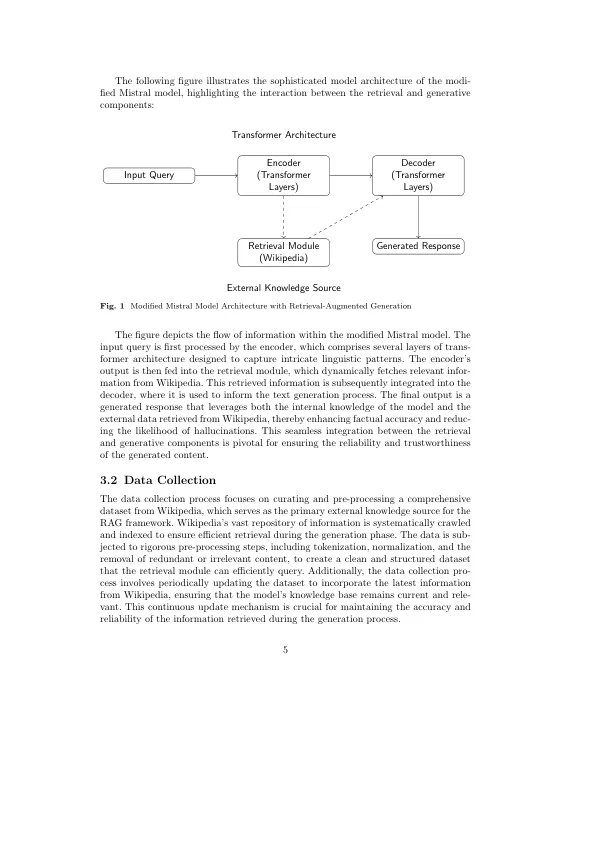

自然的语言理解和产生已经取得了长足的进步,但持续的幻觉问题破坏了模型输出的可靠性。用外部知识来源(例如Wikipedia)介绍了检索提示的一代(RAG),提出了一种新颖而重要的方法来增强生成内容的事实准确性和连贯性。通过动态整合相关信息,Mistral模型表明了精度,回忆和整体响应质量的重大改进。本研究为减轻幻觉提供了一个强大的框架,为在关键应用程序中部署可靠的AI系统提供了宝贵的见解。全面的评估不足以提高抹布的潜力,以提高大语言模型的性能和可信度。

使用Wikipedia知识

主要关键词