机构名称:

¥ 1.0

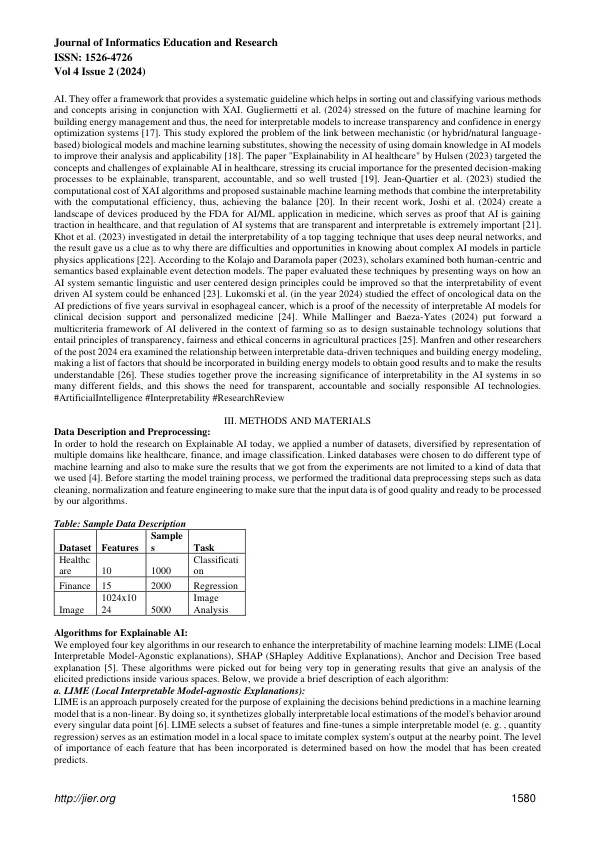

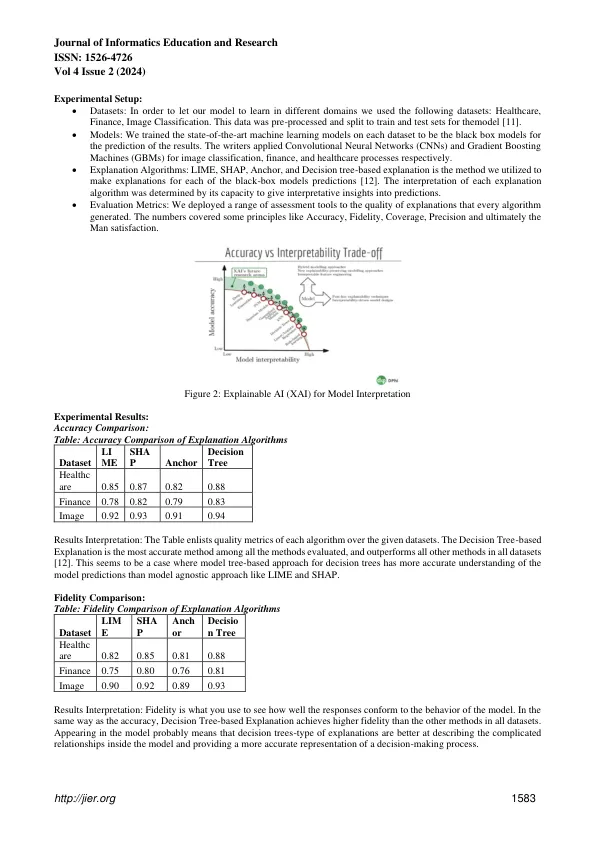

摘要:可解释的AI(XAI)是机器学习模型中关键的改变游戏规则的功能之一,这有助于使它们在不同的应用中更透明,调节和可用。在对本文的调查中,我们考虑了四行解释方法(基于Lime,Shap,锚和基于决策树的解释),以阐明不同领域内黑匣子模型的决策过程。在我们的实验中,我们使用涵盖不同领域的数据集,例如健康,金融和图像分类,并比较每种解释方法的准确性,忠诚度,覆盖率,精度,精度和人类满意度。我们的工作表明,与其他非模型特异性的解释方法相比,指称的规则树方法(基于决策树的解释)大多是优越的,无论分类器如何,都具有更高的准确性,忠诚度,覆盖率和精度。除此之外,回答定性评估的受访者表明,他们对基于决策的解释非常满意,并且这些类型的解释非常容易且易于理解。此外,大多数受访者都闻名,这些澄清更具本能和意义。过度发现,利用可解释的AI策略来促进机器学习模型与人类理解之间的漏洞,从而在AI驱动的决策中提高直接性和责任感。关键字:可解释的AI,可解释性,选择树,机器学习,直截了当。

可解释的AI:弥合机器学习模型与

主要关键词