机构名称:

¥ 1.0

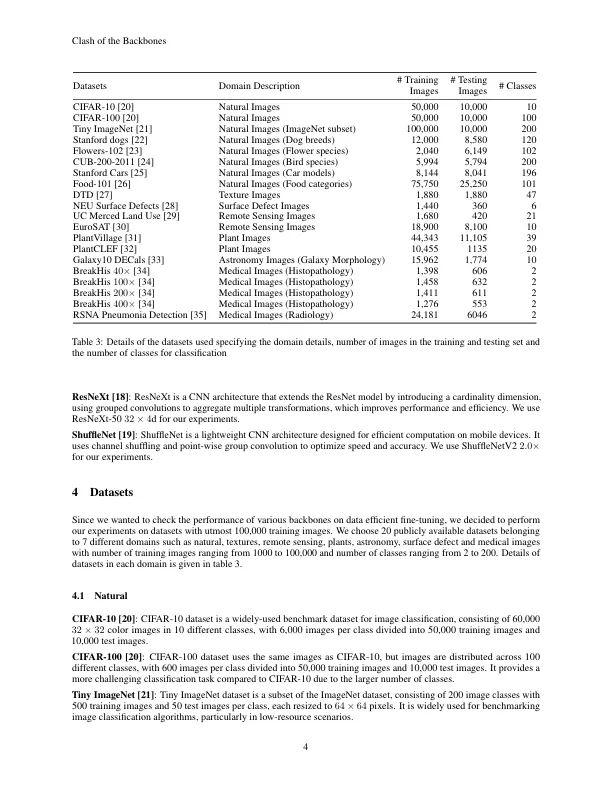

在当代计算机视觉应用中,尤其是图像分类中,在像Imagenet这样的大型数据集上预先训练的建筑背骨通常被用作特征提取器。尽管这些预训练的卷积神经网络(CNN)广泛使用,但在理解各种各样的功能和数据集大小的各种资源有效骨干的性能方面仍然存在差距。我们的研究系统地评估了多个数据集的一致训练设置,包括自然图像,医学图像,银河系图像和遥感图像,在一致的训练设置下进行了多次轻巧,预训练的CNN骨干。这种全面的分析旨在帮助机器学习从业人员为其特定问题选择最合适的骨干,尤其是在涉及细调预培训网络的小型数据集的情况下。尽管基于注意力的架构越来越受欢迎,但我们观察到,与CNN相比,它们在低数据微调任务下的性能往往较差。我们还观察到,与其他CNN架构(例如Convnext,Regnet和EfficityNet)相比,与其他各种领域相比,相比之下。我们的发现提供了可行的见解,以实现不同骨架的折衷权和有效性,从而促进了模型选择中明智的决策,以获得广泛的计算机视觉域。我们的代码可在此处提供:https://github.com/pranavphoenix/backbones

要使用哪个骨干:特定于Aresource效率的域...

主要关键词