机构名称:

¥ 1.0

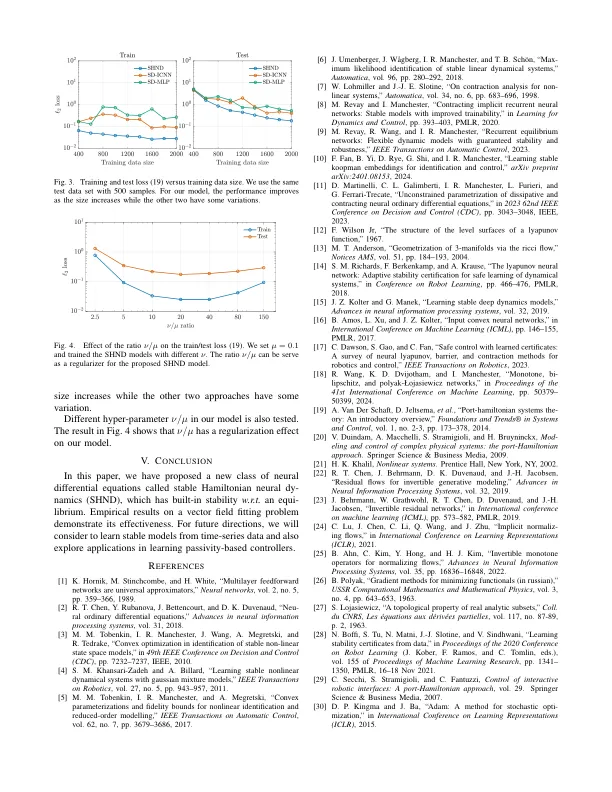

神经网络在学习和控制方面表现出了巨大的力量,尤其是在学习动力学和预测动态系统的行为方面[1],[2]。在学习和控制社区近似动态行为时,尤其是稳定性和被动性时,就会有利于稳定性和被动性。执行稳定性可以使学习模型受益,尤其是在概括方面。对于非线性系统,在[3],[4],[5]中使用高斯混合模型和多个数字模型研究了学习过程中的稳定性,甚至在线性系统的情况下,它是非平凡的[6]。对于非线性系统,存在各种稳定概念,其影响不同。在学习的背景下,一个称为Contaction [7](任何一对轨迹相互收敛)的强稳定性概念最近由于其平衡 - 独立的稳定性性质而受到了很多关注。对于离散时间设置,[8],[9],[10]已经开发了收缩,逐渐被动和耗散性神经动力学。在[11]中可以找到连续的时间对应物。[9],[11]的好处是他们的直接(即稳定模型的参数化参数化,使培训变得容易。但是,一个限制是它们在国家独立的二次度量标准方面执行收缩,从而限制了灵活性。用于学习稳定性弱的动态系统(例如,Lyapunov稳定性W.R.T.特定的平衡)通常需要应用保留相似稳定性特性的模型。稳定神经差异方程的关键成分是神经Lyapunov功能。从[12]和佩雷尔曼(Perelman)[13]的庞加罗猜想分辨率,所有lyapunov函数均具有对单位球的同型集合。这建议搜索候选Lyapunov

学习稳定和被动的神经微分方程

主要关键词