机构名称:

¥ 1.0

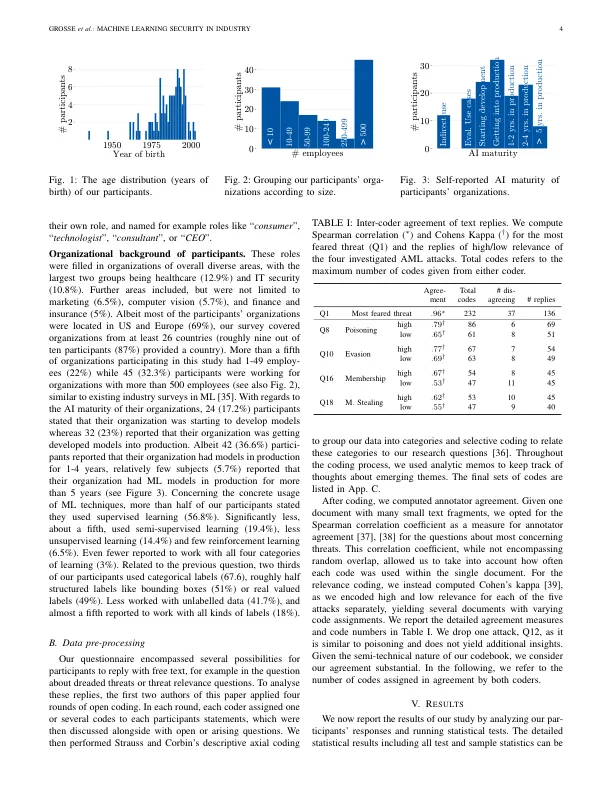

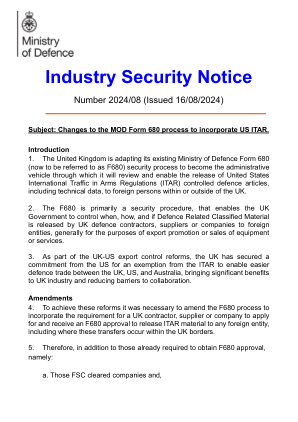

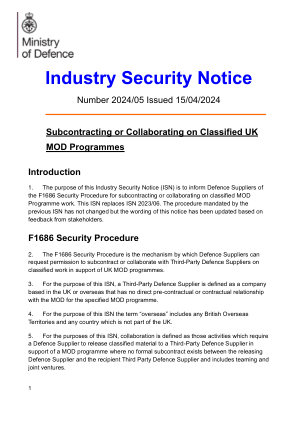

摘要 - 尽管在机器学习安全方面进行了大量的学术工作,但对野外机器学习系统的攻击的发生知之甚少。在本文中,我们对139个工业实践的定量研究进行了报告。我们分析了攻击发生和关注,并评估统计假设对影响威胁感知和暴露的因素。我们的结果阐明了对部署机器学习的现实世界攻击。在组织层面上,虽然我们没有预测样本中威胁暴露的预测因素,但实施防御量取决于暴露于威胁或预期成为目标的可能性。我们还提供了从业人员对单个机器学习攻击的相关性的答复,揭示了不可靠的决策,业务信息泄漏和偏见引入模型等复杂问题。最后,我们发现,在个人层面上,关于机器学习安全性影响威胁感知的先验知识。我们的工作为在实践中的对抗机器学习方面进行更多研究铺平了道路,但收益率也可以洞悉调节和审计。

行业中的机器学习安全:定量调查

主要关键词