机构名称:

¥ 1.0

摘要:随着AI的发展,了解复杂的AI决策背后的基本原理变得越来越重要。解释AI技术在揭开这些决策的神秘面前至关重要,提供了解释和传达AI驱动结果背后推理的方法和工具。然而,可解释的AI的兴起与保护敏感数据的必要性并列,从而导致加密技术在AI开发中的整合。本文探讨了AI中解释性和加密的复杂共存,呈现出一个困境,在这种困境中,寻求透明度与确保敏感信息的势在必行。矛盾在诸如同形加密之类的方法中尤为明显,在确保数据安全性的同时,它使为AI决策提供了清晰可解释的解释。讨论深入研究了这些方法的矛盾目标,调查了在Exable AI中使用隐私的方法的使用,并确定了未来研究的潜在方向。的贡献包括对当前可解释的AI方法中隐私注意事项的全面调查,一种模范用例,展示了可视化技术,可在安全环境中进行解释,并确定未来工作的途径。

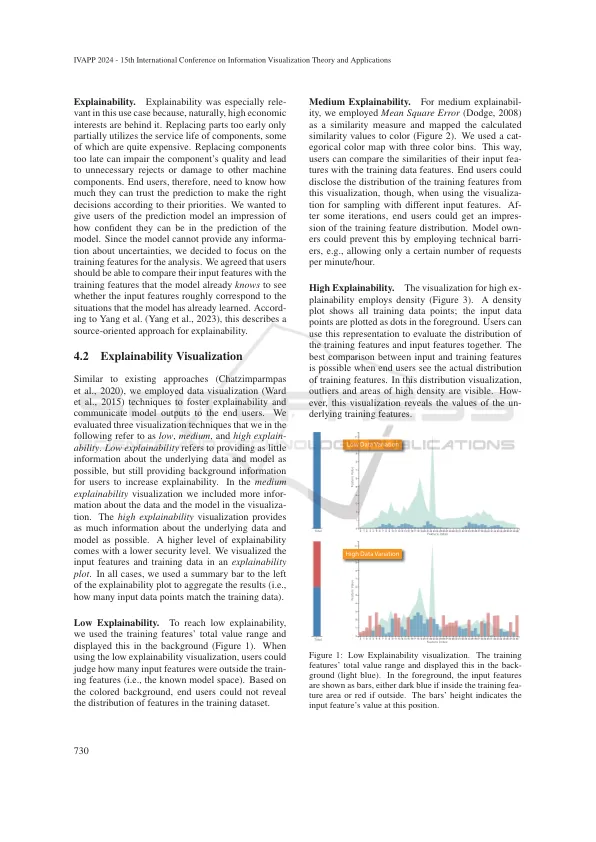

在解释性和隐私之间进行权衡