机构名称:

¥ 2.0

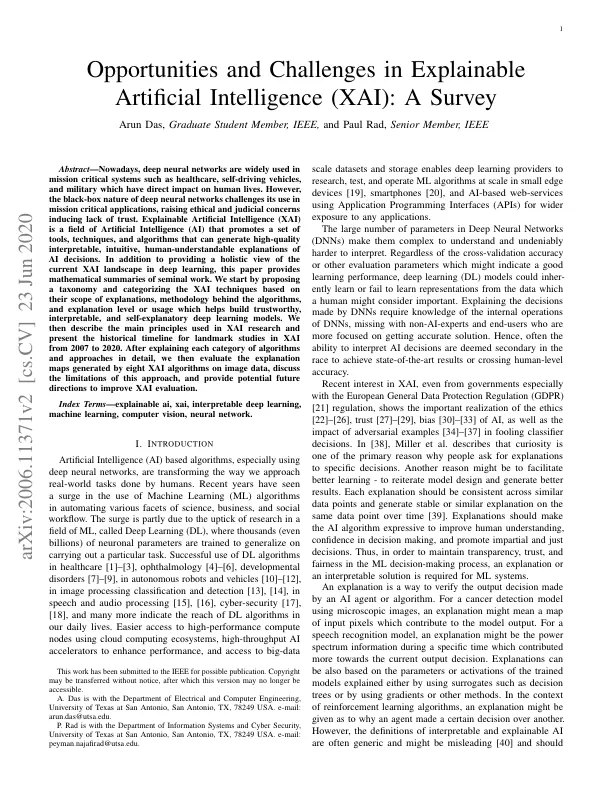

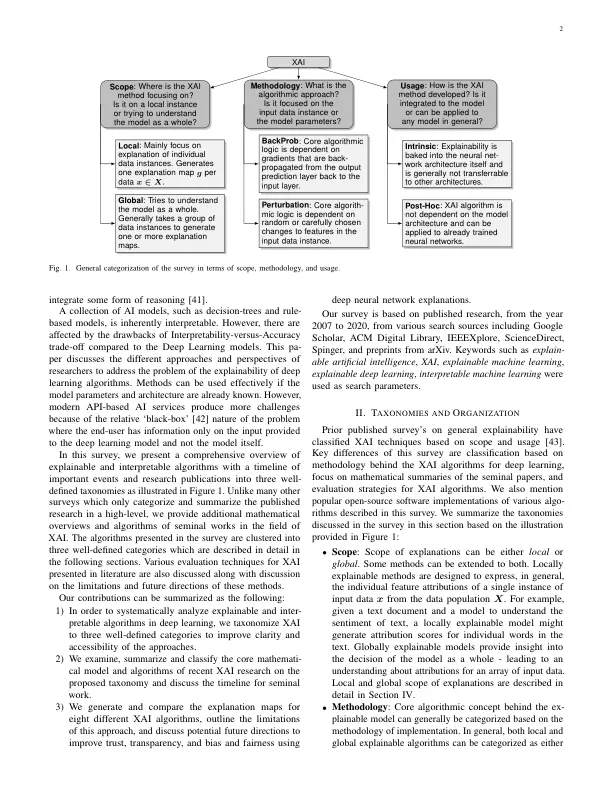

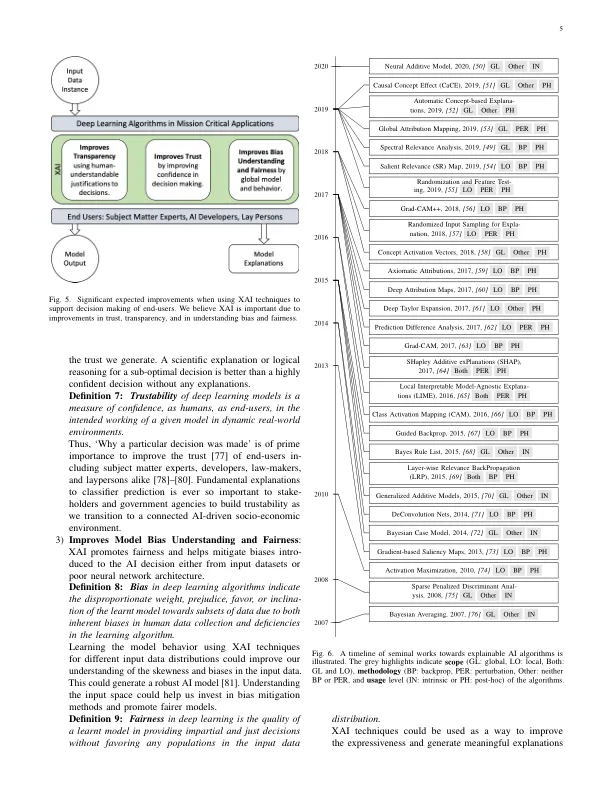

摘要 — 如今,深度神经网络广泛应用于医疗保健、自动驾驶汽车和军事等对人类生活有直接影响的关键任务系统。然而,深度神经网络的黑箱性质对其在关键任务应用中的使用提出了挑战,引发了道德和司法问题,导致缺乏信任。可解释人工智能 (XAI) 是人工智能 (AI) 的一个领域,它推广一套工具、技术和算法,可以生成高质量、可解释、直观、人类可理解的 AI 决策解释。除了提供深度学习中当前 XAI 格局的整体视图外,本文还提供了开创性工作的数学摘要。我们首先提出一个分类法,并根据 XAI 技术的解释范围、算法背后的方法论以及解释级别或用途对其进行分类,这有助于构建可信、可解释和不言自明的深度学习模型。然后,我们描述 XAI 研究中使用的主要原理,并介绍 2007 年至 2020 年 XAI 里程碑式研究的历史时间表。在详细解释每类算法和方法之后,我们将评估八种 XAI 算法在图像数据上生成的解释图,讨论这种方法的局限性,并提供改进 XAI 评估的潜在未来方向。

可解释人工智能的机遇与挑战......

主要关键词