机构名称:

¥ 1.0

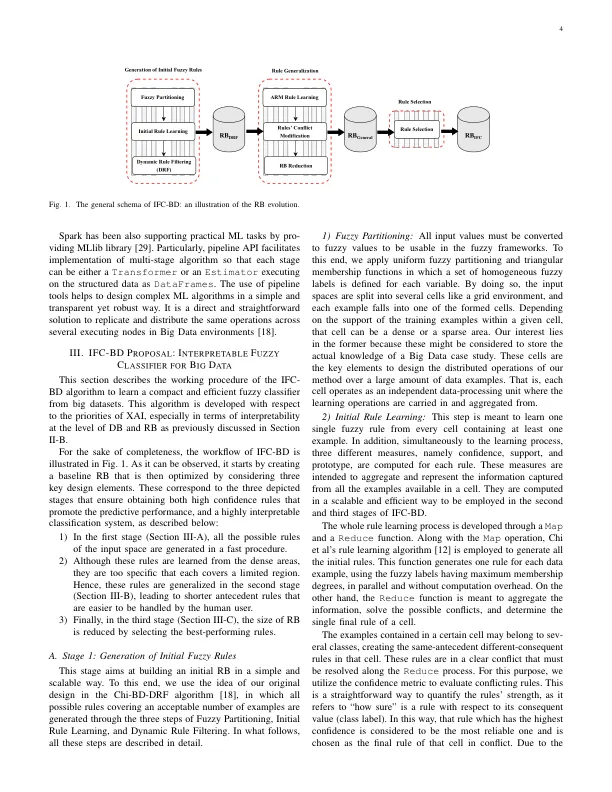

摘要 — 在当前的数据科学应用中,行动的方向是使系统行为适应人类认知,从而产生了可解释人工智能这一新兴领域。在不同的分类范式中,基于模糊规则的分类范式是强调全局系统可解释性的合适解决方案。然而,在处理大数据分析时,它们可能包含过多的规则和/或语言标签,这不仅可能导致系统性能下降,还可能影响系统语义以及系统可解释性。在本文中,我们提出了 IFC-BD,一种用于大数据的可解释模糊分类器,旨在通过学习紧凑而准确的模糊模型来提升可解释性的范围。IFC-BD 是在基于单元的分布式框架中通过初始规则学习、规则泛化和启发式规则选择三个工作阶段开发的。整个过程允许从大量特定规则扩展到更少数量的更通用和更可信的规则。此外,为了解决可能出现的规则冲突,我们专门针对大数据问题提出了一种新的估计规则权重。我们将 IFC-BD 与模糊分类范式的最新方法进行了比较,考虑了可解释性、准确性和运行时间。实验结果表明,所提出的算法能够提高基于模糊规则的分类器的可解释性及其预测性能。

IFC-BD:一种可解释的模糊分类器,用于提升……

主要关键词