机构名称:

¥ 2.0

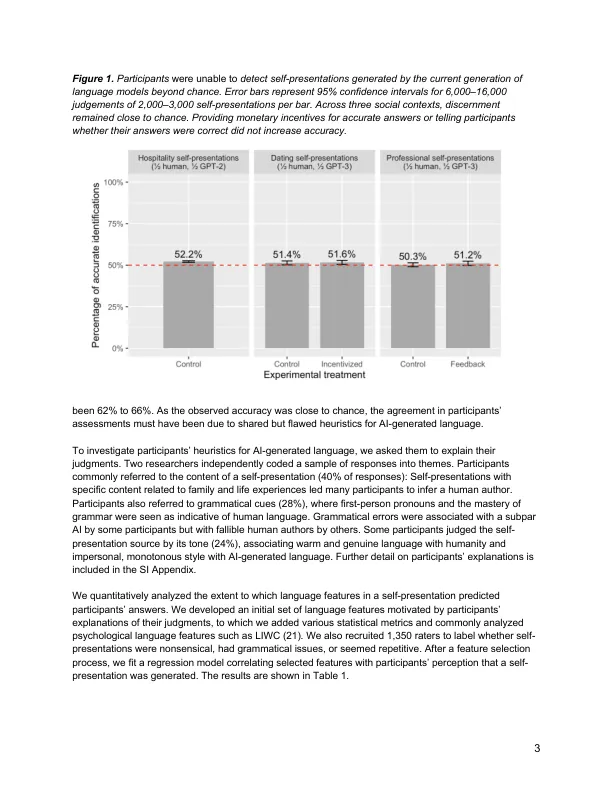

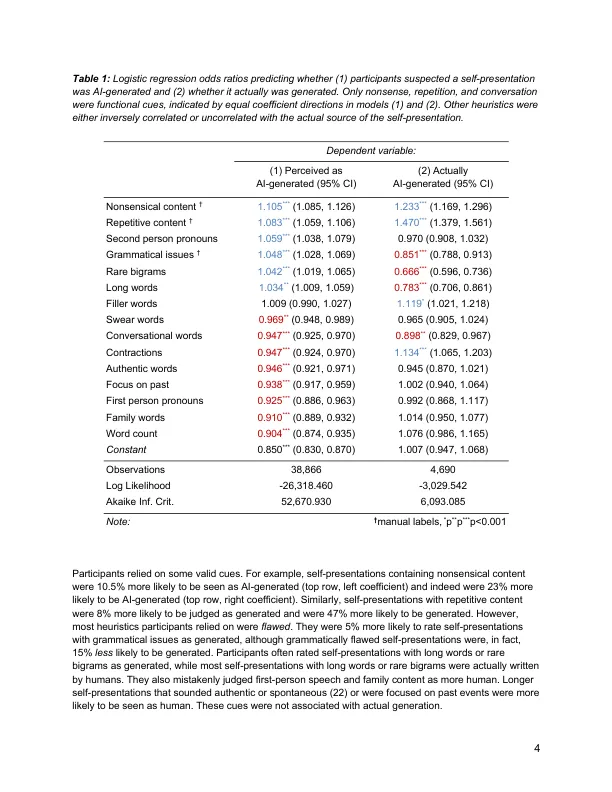

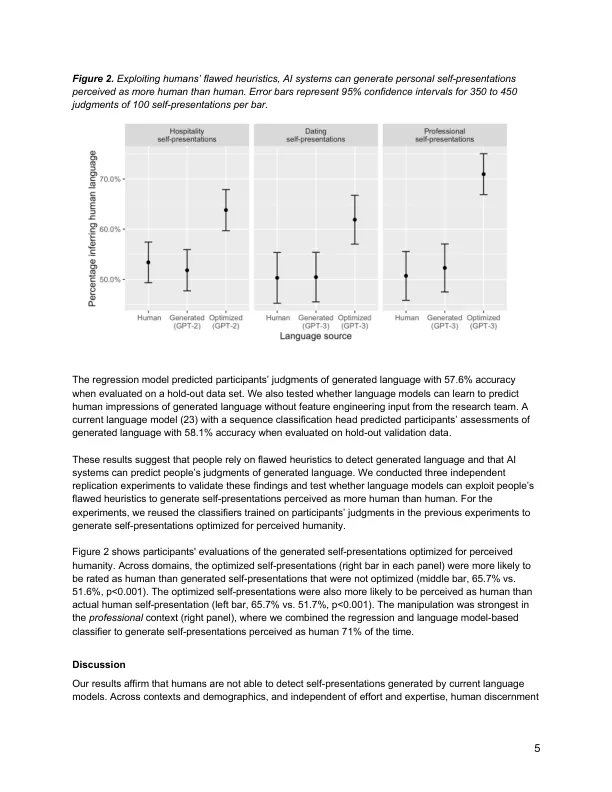

人类交流越来越多地与人工智能生成的语言混合在一起。在聊天、电子邮件和社交媒体中,人工智能系统可以生成智能回复、自动完成和翻译。人工智能生成的语言通常不会被识别为人类语言,而是冒充人类语言,这引发了人们对新型欺骗和操纵形式的担忧。在这里,我们研究人类如何辨别最个人化和最重要的语言形式之一——自我呈现——是否由人工智能生成。在六项实验中,参与者(N = 4,600)试图检测由最先进的语言模型生成的自我呈现。在专业、酒店和约会环境中,我们发现人类无法检测人工智能生成的自我呈现。我们的研究结果表明,人类对人工智能生成语言的判断受到直觉但有缺陷的启发式方法的限制,例如将第一人称代词、自发措辞或家庭话题与人性联系起来。我们证明这些启发式方法使人类对生成语言的判断变得可预测和可操纵,从而使人工智能系统能够生成被认为比人类更人性化的语言。我们讨论了诸如 AI 口音之类的解决方案,以减少生成语言的欺骗潜力,限制对人类直觉的颠覆。

人工智能生成语言的人类启发法存在缺陷