机构名称:

¥ 1.0

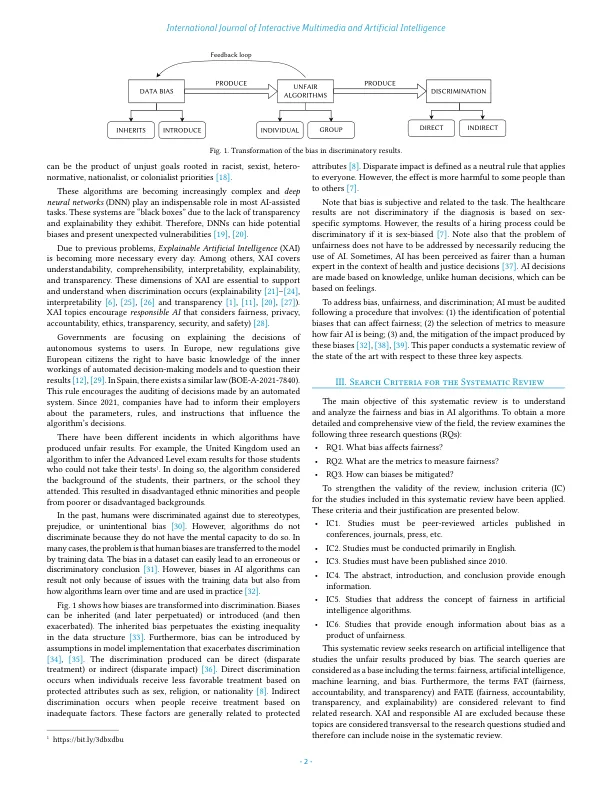

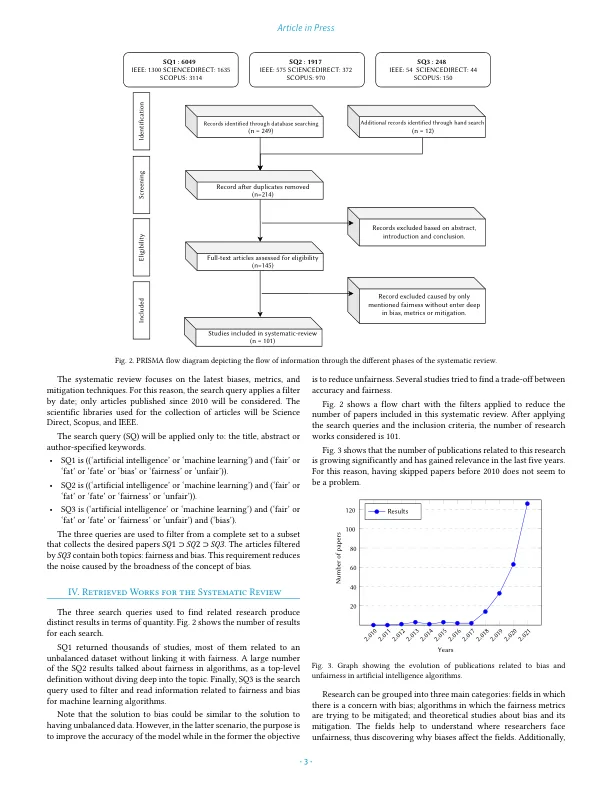

决策系统的自动化导致了人工智能 (AI) 使用中的隐藏偏见。因此,解释这些决策和确定责任已成为一项挑战。因此,出现了一个新的算法公平性研究领域。在这个领域,检测偏见并减轻偏见对于确保公平和无歧视的决策至关重要。本文的贡献包括:(1) 对偏见进行分类,以及偏见与人工智能模型开发的不同阶段(包括数据生成阶段)的关系;(2) 修订公平性指标以审核数据和用它们训练的人工智能模型(在关注公平性时考虑不可知模型);(3) 对减轻人工智能模型开发不同阶段(预处理、训练和后处理)偏见的程序进行新的分类,并增加有助于生成更公平模型的横向行动。

人工智能中的偏见与公平性回顾