机构名称:

¥ 1.0

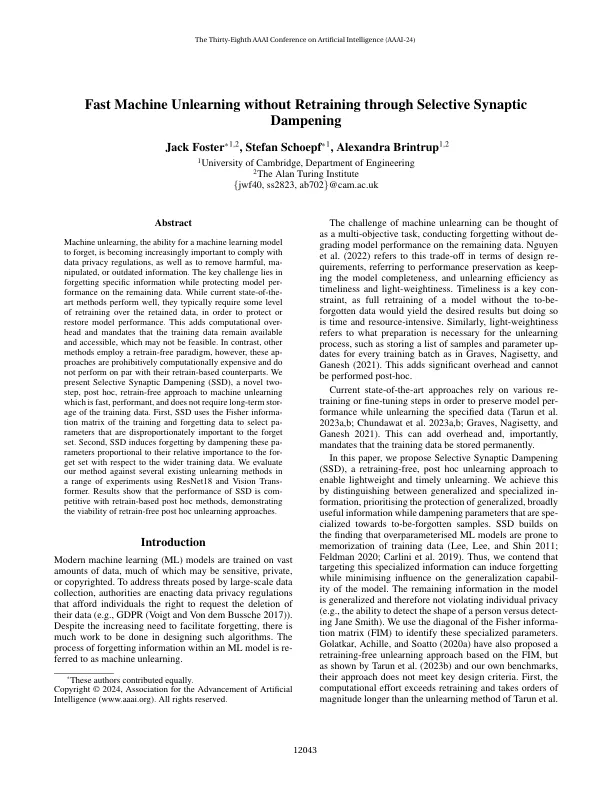

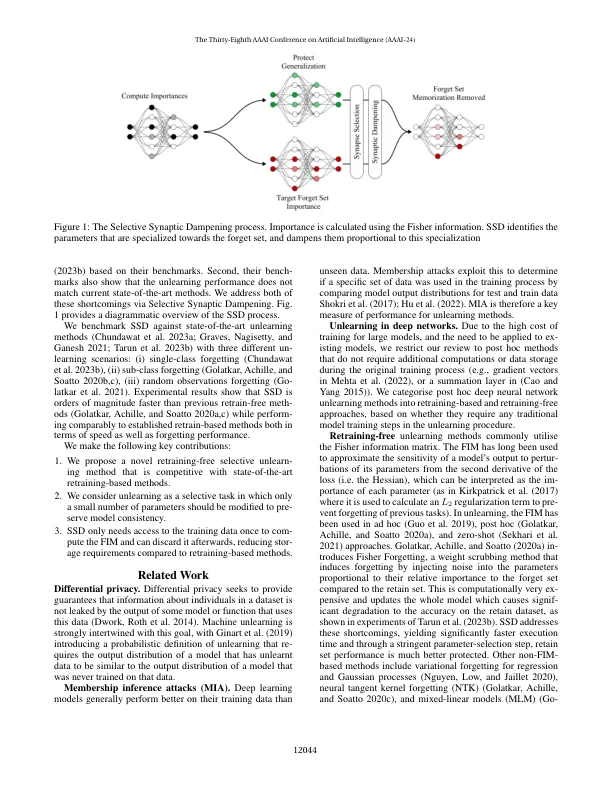

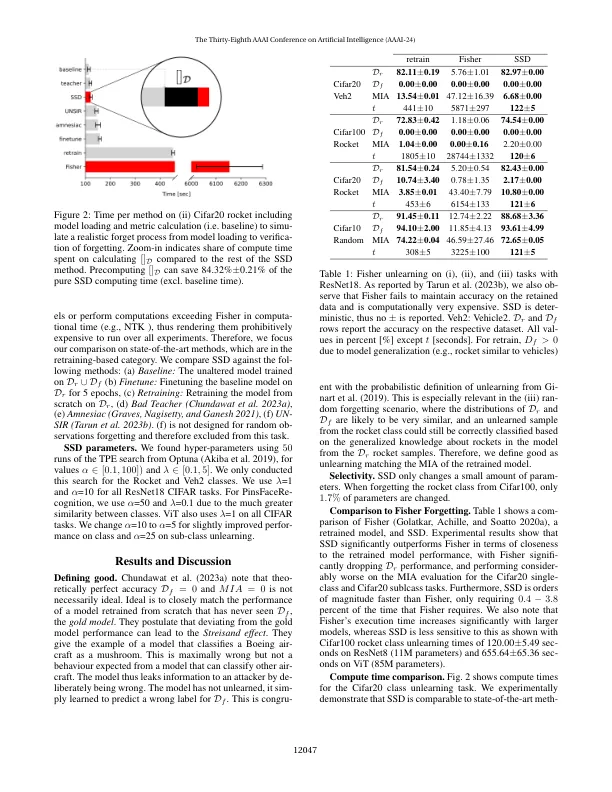

机器反学习,即机器学习模型的遗忘能力,在遵守数据隐私法规以及删除有害、被操纵或过时信息方面变得越来越重要。关键挑战在于忘记特定信息,同时保护模型在剩余数据上的性能。虽然当前最先进的方法表现良好,但它们通常需要对保留的数据进行一定程度的再训练,以保护或恢复模型性能。这增加了计算开销,并要求训练数据保持可用和可访问,而这可能是不可行的。相比之下,其他方法采用无再训练范式,但这些方法的计算成本过高,且性能不如基于再训练的方法。我们提出了选择性突触抑制 (SSD),这是一种新颖的两步、事后、无再训练的机器反学习方法,它速度快、性能好,并且不需要长期存储训练数据。首先,SSD 使用训练和遗忘数据的 Fisher 信息矩阵来选择对遗忘集不成比例的重要参数。其次,SSD 通过抑制这些参数来诱导遗忘,抑制程度与它们相对于更广泛的训练数据对遗忘集的相对重要性成正比。我们在一系列使用 ResNet18 和 Vision Transformer 的实验中将我们的方法与几种现有的反学习方法进行了比较。结果表明,SSD 的性能与基于再训练的事后方法相媲美,证明了无再训练事后反学习方法的可行性。

通过选择性突触抑制实现快速机器去学习,无需再训练

主要关键词