机构名称:

¥ 1.0

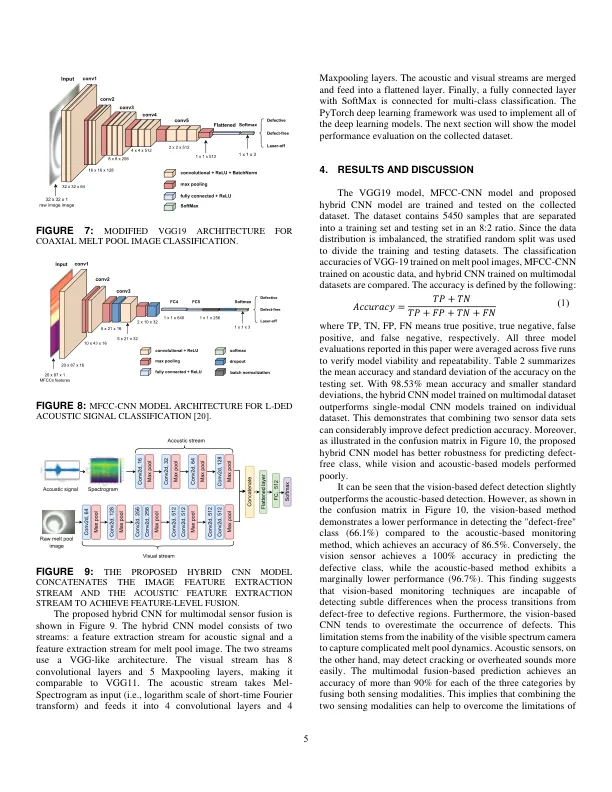

实时缺陷检测对于激光定向能量沉积 (L-DED) 增材制造 (AM) 至关重要。传统的现场监测方法利用单个传感器(即声学、视觉或热传感器)来捕获复杂的过程动态行为,这不足以实现高精度和稳健性的缺陷检测。本文提出了一种新颖的多模态传感器融合方法,用于实时位置相关的机器人 L-DED 过程中的缺陷检测。多模态融合源包括捕捉激光-材料相互作用声音的麦克风传感器和捕捉同轴熔池图像的可见光谱 CCD 相机。提出了一种混合卷积神经网络 (CNN) 来融合声学和视觉数据。本研究的主要创新之处在于不再需要传统的手动特征提取程序,原始熔池图像和声学信号直接由混合 CNN 模型融合,该模型无需热传感模式即可实现最高的缺陷预测准确率 (98.5%)。此外,与以前基于区域的质量预测不同,所提出的混合 CNN 可以检测到缺陷发生的开始。缺陷预测结果与现场获取的机器人工具中心点 (TCP) 数据同步并注册,从而实现局部缺陷识别。所提出的多模态传感器融合方法为现场缺陷检测提供了一种可靠的解决方案。

用于实时位置相关缺陷的多模态传感器融合

主要关键词