机构名称:

¥ 1.0

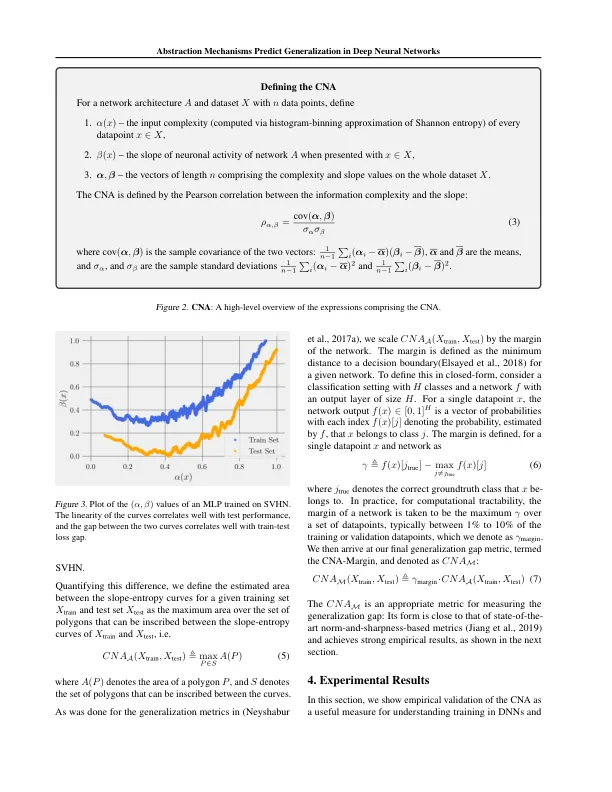

深度神经网络作品(DNN)的一个长期问题是了解他们令人困惑的概括能力。We approach this prob lem through the unconventional angle of cogni tive abstraction mechanisms , drawing inspiration from recent neuroscience work, allowing us to define the Cognitive Neural Activation metric (CNA) for DNNs, which is the correlation be tween information complexity (entropy) of given input and the concentration of higher activation values in deeper layers of the network.CNA具有高度预测的概括能力,在对近200个网络实例的广泛评估中进行基于规范和偏见的概括指标,其中包括数据集构造组合的广度,尤其是在存在加性噪声的情况下,并且存在/或培训标签被损坏。这些强大的EM PIRICAL结果表明,CNA作为概括度量的有用性,并鼓励对信息复杂性与更深层次网络中的表示之间的联系进行进一步研究,以便更好地了解DNN的概括能力。1

抽象机制预测深度神经网络中的概括

主要关键词