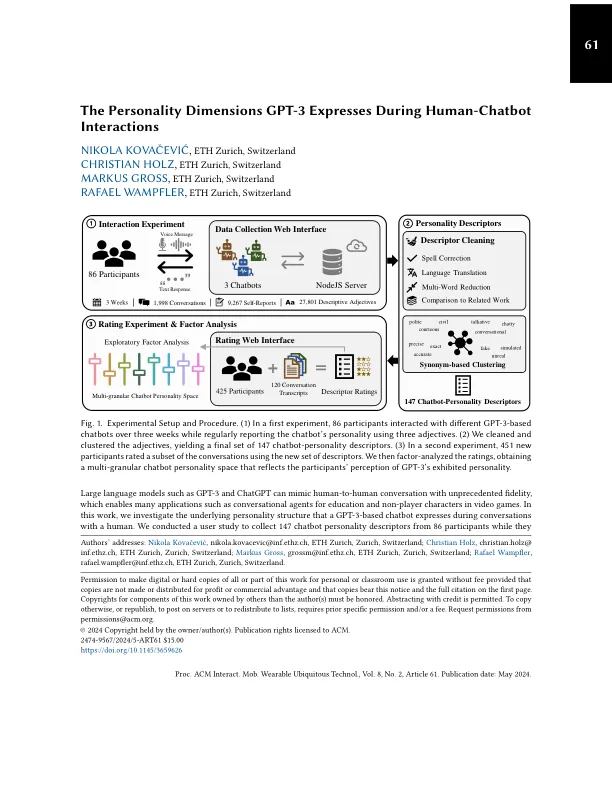

1简介大型生成语言模型(LLM)的最新出现,例如GPT-3 [16]及其继任者Chatgpt [96]和GPT-4 [83],彻底改变了自然语言处理和人工智能领域。由于他们具有前所未有的精度处理自然语言的能力,这些模型在各种环境中开放了新的应用程序和用例[26,35,96]。具体来说,它们产生的文本通常与人类生成的文本无法区分的能力使它们可以用作对话剂[57,62,86,108],从而增加了可信性[70,106],浸入性[52]和互动的个性化[58]。在游戏[2,5]中成功地改编了这种对话代理为非玩家字符(NPC),并对教学应用显示了巨大的希望[1]。然而,考虑到有关一致性和用户影响的问题仍未解决,必须对这种技术进行集成[27、55、57、74]。诸如安全和内容控制问题之类的新挑战阻碍了该技术进入高风险应用程序,例如教育和心理保健服务,那里没有任何不一致或适得其反的毒剂行为的空间[9,82]。因此,必须研究人类如何与基于LLM的对话剂相互作用,并了解在这种相互作用情况下出现的风险和挑战。人类肉体相互作用的一个重要方面是对转化药物的人格的设计和控制[32,33,109]。传达对话剂中的个性使交互作用引人入胜且令人信服,使用户拟人化代理[40,66],增强用户参与度[88]和用户体验[91],并通过高度个性化[98]来增加用户对代理的接受。然而,关于语音服务助理(例如Siri和Alexa)所表现出的人格的最新发现[103]表明,建立完善的人格模型(例如五因子模型[25,69])与用户与此类助手相互作用时所感知的人格之间存在结构差异。这导致了一个问题,即最近基于LLM的对话代理人表现出的人格尺寸在多大程度上与人格模型一致,以及这些维度是否与先前工作中得出的维度一致。研究这种结构差异是必须将代理人个性的设计与用户的感知和期望保持一致[103,104],从而使基于LLM的对话代理在人格维度方面实现系统的设计,评估和比较。在这项工作中,我们研究了在人类聊天对话期间由基于GPT-3的聊天机器人表达的潜在人格结构,并将结果与Völkel等人的演员人格模型进行了比较。[103]和人格的五因素模型[25,69]。在我们的研究中(见图1),有86名参与者在与聊天机器人交谈的同时定期将基于GPT-3的聊天机器人的个性描述。我们通过执行包括拼写的多个处理步骤

人格维度GPT-3在人类肉体相互作用期间表达

主要关键词