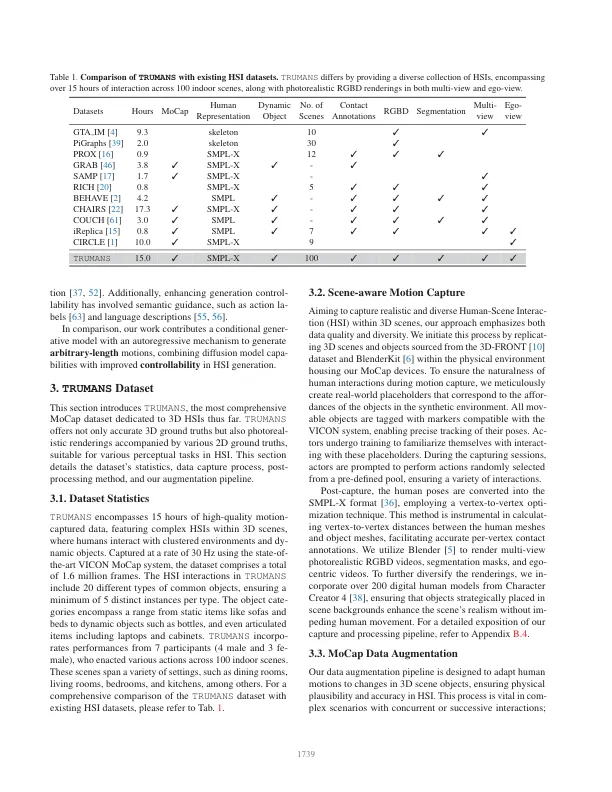

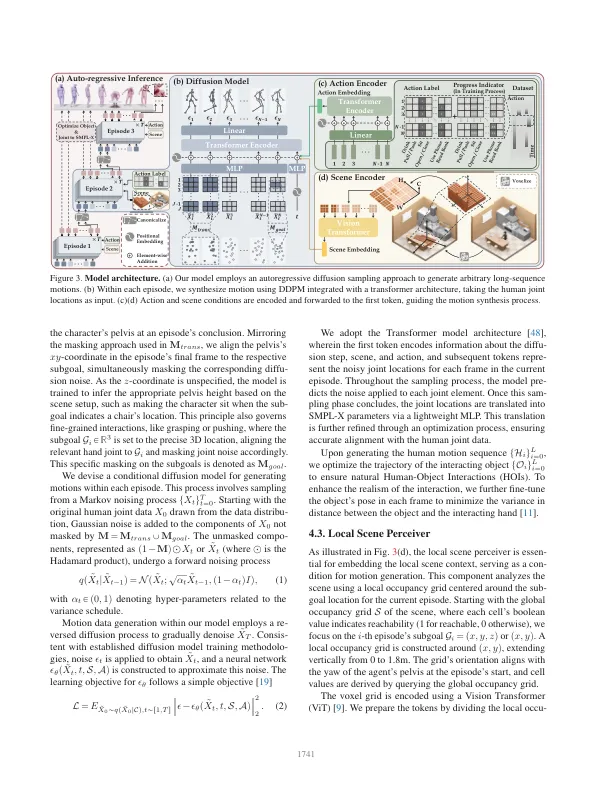

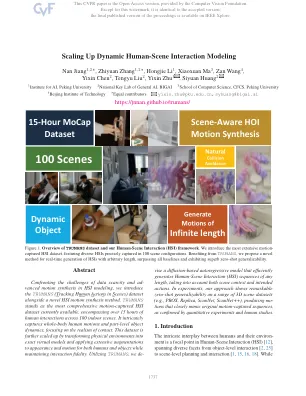

已经取得了显着的迈进,该领域显然是由于缺乏高质量数据集而导致的。早期数据集(如Pigraphs [39]和Prox [16])启动了探索,但受到可扩展性和数据质量的约束。MOCAP数据集[14,30]使用Vicon等复杂的设备优先考虑高质量的人类运动限制。但是,他们通常缺乏捕获多样化和沉浸式的HSI。通过RGBD视频录制的可扩展数据集提供了更广泛的实用程序,但受到人类姿势和对象跟踪质量较低的阻碍。合成数据集的出现[1,3,4,55]提供了成本效率和适应性,但无法封装完整的现实HSI频谱,尤其是在捕获动态3D触点和对象跟踪时。为了应对这些挑战,这项工作首先引入了trumans(t rack hum a um a u u u u u u u u u u u u u u a ctio n s in s cenes)数据集。Trumans成为最广泛的运动捕获HSI数据集,涵盖了15个小时以上15个小时的室内场景中的各种相互作用。它捕获了全身的人类动作和部分级别的对象动力学,重点是接触的现实主义。通过将物理环境复制到准确的虚拟模型中,可以进一步增强此数据集。外观和运动的广泛增强都应用于人类和物体,以确保相互作用的高度有限。接下来,我们设计了一个计算模型,通过将场景和动作作为条件同时采取行动来应对上述挑战。我们对杜鲁士数据集和运动合成方法进行了全面的交叉评估。特别是,我们的模型采用自回归的条件扩散,场景和动作嵌入作为征用输入,能够产生任意长度的运动。为了整合场景上下文,我们通过在本地化的基础上查询全局场景的占用来开发有效的场景感知者,这在导航杂乱的场景时表现出了3D感知的碰撞避免的强大效率。为了将框架的动作标签合并为条件,我们将时间特征集成到动作片段中,使模型在粘附在给定的动作标签时随时接受指令。场景和动作条件的这种双重整合增强了我们方法的可控性,为在3D场景中合成合理的长期运动提供了细微的界面。将trumans与现有人物进行比较,我们证明了杜鲁士人明显提高了最先进的方法的性能。此外,我们的方法在定性和定量上进行了评估,超过了现有的运动综合方法,其质量和零击性能力在看不见的3D场景上,非常接近原始运动捕获数据的质量。除了运动合成之外,杜鲁士人已经针对人类的姿势和接触估计任务进行了基准测试,证明了其多功能性并将其确立为一系列未来的研究努力的宝贵资产。

扩展动态的人类场景相互作用建模

主要关键词