机构名称:

¥ 1.0

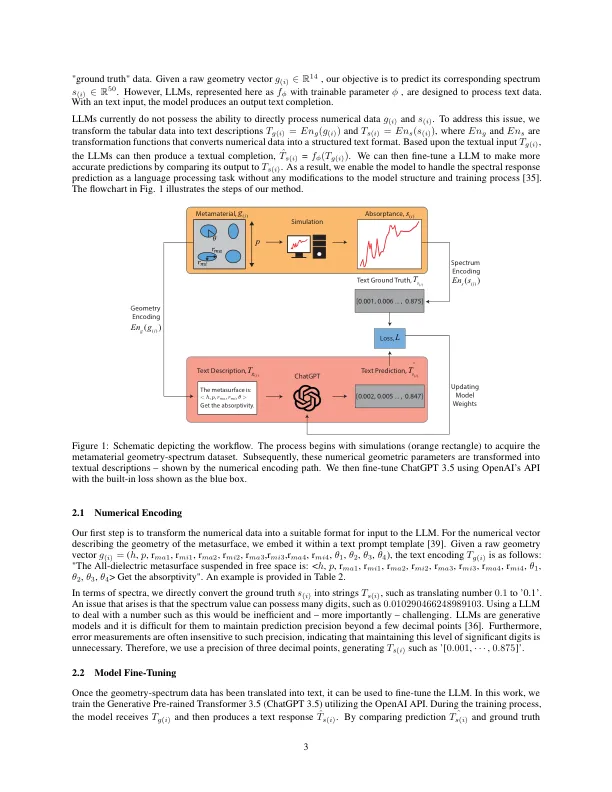

大型语言模型(LLM),例如Chatgpt,Gemini,Llama和Claude接受了从互联网解析的文本数量的培训,并且表现出了出色的能力,可以以一种与人类无法区分的方式响应复杂提示的能力。对于由带有四个椭圆形谐振器的单位细胞组成的全dielectric寄生虫,我们在多达40,000个数据上呈现了一个llmfien,可以预测只有文本提示的吸收率谱,仅指定了元时间的几何形状。将结果与传统的机器学习方法进行比较,包括馈送前向神经网络,随机森林,线性回归和K-Nearest邻居(KNN)。值得注意的是,使用深度神经网络的大型数据集尺寸的细胞调整LLM(FT-LLM)的性能可比。我们还通过要求LLM预测实现所需光谱所需的几何形状来探索反问题。llms比Humans具有多个优势,这些优点可能使他们有益于研究,包括处理大量数据,数据中发现的隐藏模式并在高维空间中运行的能力。这表明他们可能能够利用对世界的一般知识比传统模型更快地学习,从而使他们的研究和分析工具有价值。

学习电磁超物理物理

主要关键词