机构名称:

¥ 1.0

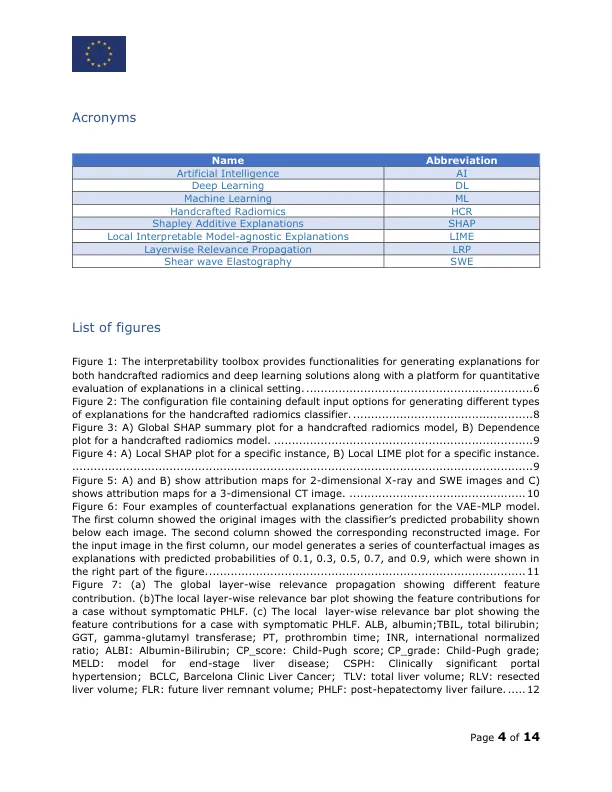

人工智能在使用医疗图像的医疗保健任务上表现出了有希望的表现。但是,有必要了解法律,道德和故障排除目的的AI模型的决策过程。本文档概述了可解释性工具箱的开发,该工具箱旨在提高手工制作的放射组学和医学成像中深度学习解决方案的透明度。对于手工制作的放射线学,该工具箱提供了用于生成Shapley添加说明,局部解释的模型 - 不合Snostic解释以及适用于任何机器学习模型的表征反事实的工具。为了深入学习,该工具箱提供了为2D和3D分类模型创建归因地图的功能,以及生成反事实图像说明的说明性示例。此外,工具箱还扩展了反事实框架以结合层的相关性传播,从而允许将临床变量纳入决策。最后,该文档展示了一个使用Python和简化构建的示例平台,该平台旨在在临床背景下验证这些解释,从而评估其在决策过程中的可用性和价值。可解释性工具箱可在以下链接中获得:https://github.com/zohaibs1995/radiomics_explainables_toolbox。

癌症成像中可解释AI的工具箱

主要关键词