机构名称:

¥ 1.0

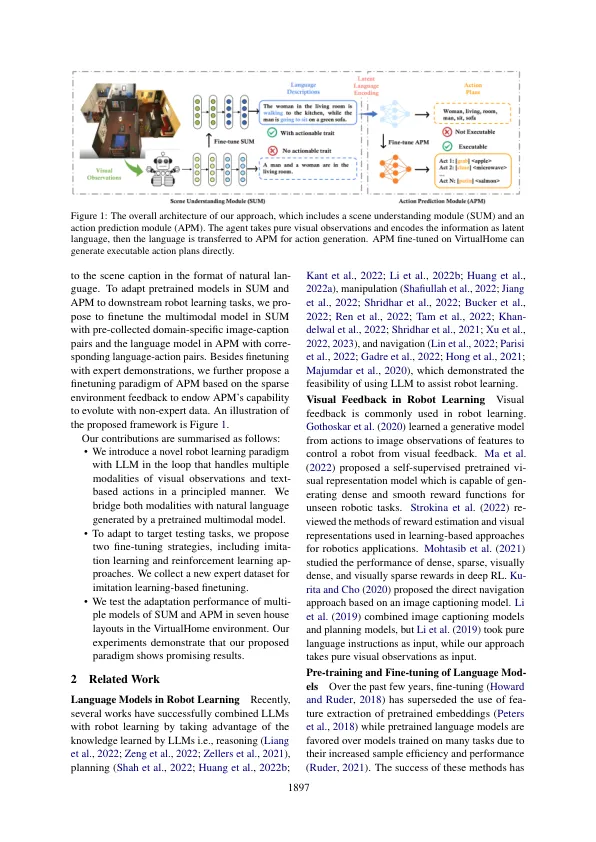

大型语言模型(LLMS)在协助机器人学习任务(即复杂的家庭计划)方面取得了巨大的成功。但是,经过验证的LLMS重量的性能依赖于特定领域的模板数据数据,这在具有基于图像的观察器的现实世界机器人学习任务中可能是不可行的。此外,现有的带有文本输入的LLM缺乏与环境非专家交互的发展能力。在这项工作中,我们引入了一种新颖的学习范式,该范式以文本的形式生成了可执行的动作,仅源自视觉观察。我们提出的范式与以前的作品不同,该作品利用语言说明或语言和视觉数据的组合作为输入。我们证明我们提出的方法可以提出两种微调策略,包括模仿学习和强化学习,以适应目标测试任务。我们进行了广泛的实验,其中涉及虚拟室环境中7个房屋布局的各种模型选择,环境和任务。我们的实验结果表明,我们的方法超过了现有的基准,证实了这种新型学习范式的有效性。

指示偏见:指导调节的语言模型表现出紧急认知偏见

主要关键词