机构名称:

¥ 1.0

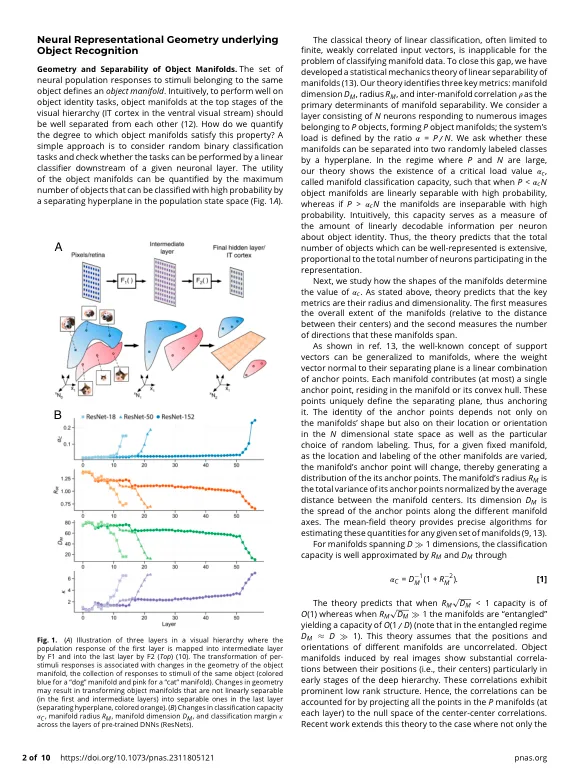

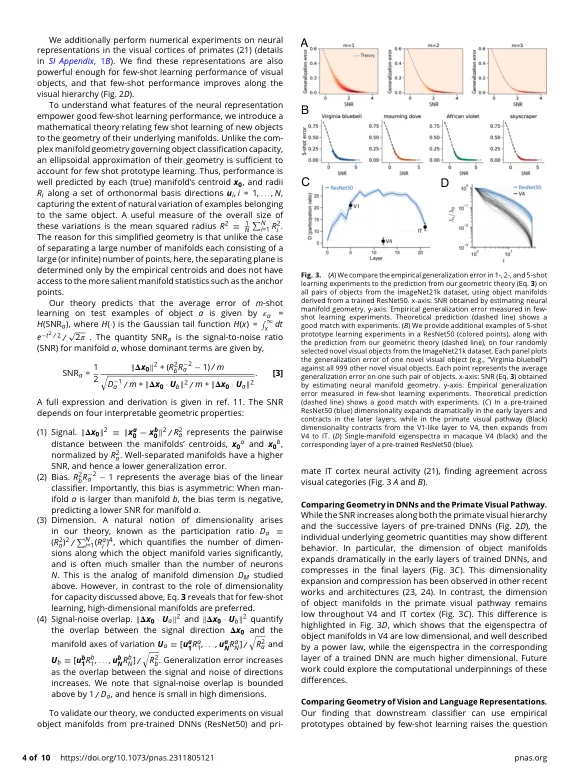

人类和动物擅长从有限的数据中进行泛化,这种能力尚未被人工智能完全复制。本视角研究生物和人工深度神经网络 (DNN) 在分布内和分布外环境下的泛化能力。我们提出两个假设:首先,与离散认知实体(如物体、词语和概念)相关的神经流形的几何性质是强大的序参量。它们将神经基础与泛化能力联系起来,并提供一种统一的方法论来弥合神经科学、机器学习和认知科学之间的差距。我们概述了神经流形几何研究的最新进展,特别是在视觉物体识别方面,并讨论了将流形维数和半径与泛化能力联系起来的理论。其次,我们认为广度 DNN 的学习理论,尤其是在热力学极限下的学习理论,为生成所需神经表征几何和泛化的学习过程提供了机制上的见解。这包括权重范数正则化、网络架构和超参数的作用。我们将探讨该理论的最新进展和持续面临的挑战。我们还将讨论学习的动态及其与大脑表征漂移问题的相关性。

人工智能和脑科学中的表征和概括...

主要关键词