机构名称:

¥ 1.0

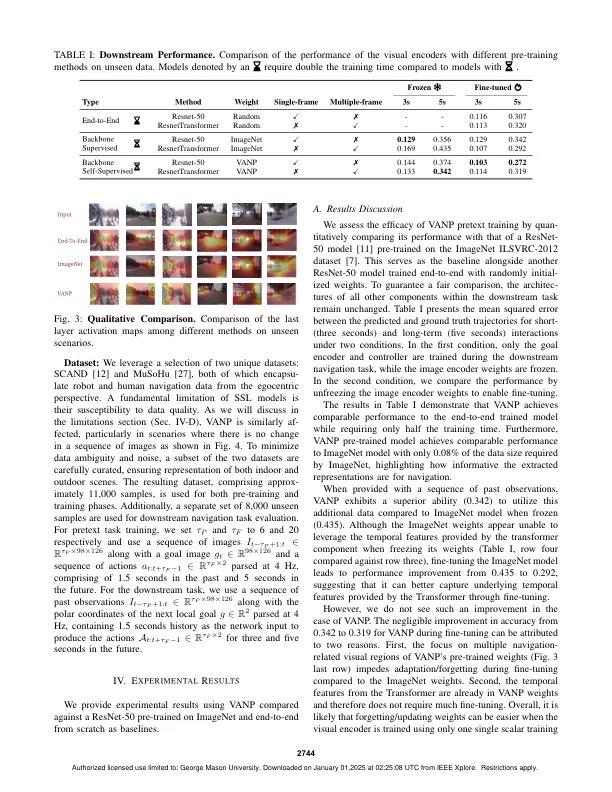

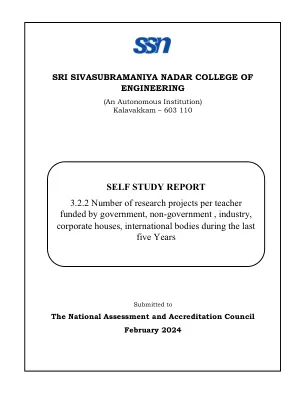

摘要 - 人类通过专注于与导航相关的特定视觉区域,在没有碰撞的情况下有效地通过人群导航。但是,大多数机器人视觉导航方法都依赖于对视觉任务进行预训练的深度学习模型,这些模型优先考虑显着对象,而不一定与导航和潜在的误导有关。替代方法从头开始训练专业导航模型,需要大量计算。另一方面,自我监督的学习彻底改变了计算机视觉和自然语言处理,但是由于难以定义有效的自学信号,因此其在机器人导航中的应用仍未被忽略。是由这些观察结果激励的,在这项工作中,我们为视觉导航预训练(VANP)提出了一种自我监督的视觉动作模型。而不是检测对分类或检测等任务有益的显着对象,而是学会仅专注于与导航任务相关的特定视觉区域。为了实现这一目标,VANP使用了视觉观察的历史记录,未来的动作和一个自upervision的目标图像,并使用两个小型变压器编码器嵌入它们。然后,通过使用共同信息最大化目标函数,VANP最大化嵌入之间的信息。我们证明了大多数VANP提取的功能与人类导航直觉匹配。vanp的性能可相当,因为模型学习了端到端的一半训练时间和在大规模,完全监督的数据集(即Imagenet)上进行培训的模型,只有0.08%的数据。1

vanp:学习自我导航的位置...

主要关键词