机构名称:

¥ 2.0

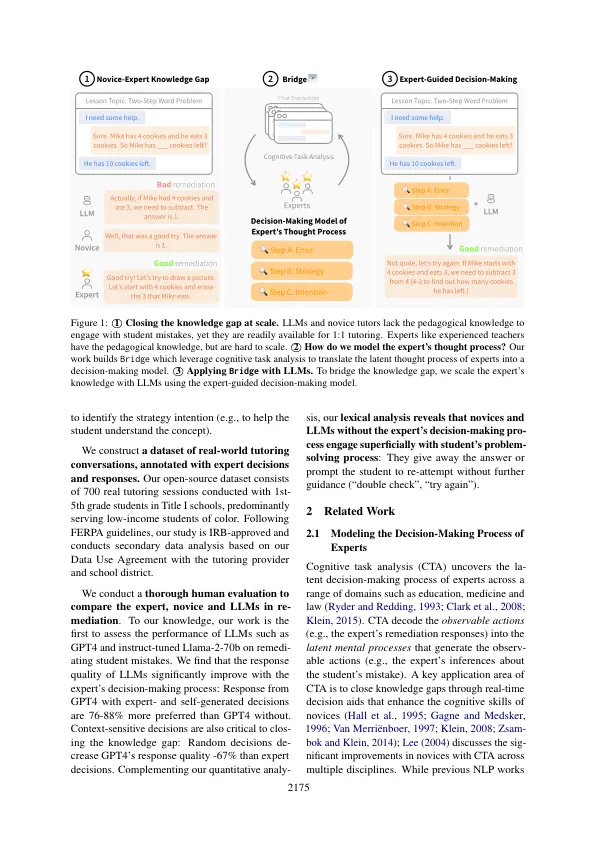

扩展高质量的辅导仍然是教育中的主要挑战。由于不断增长,许多平台雇用了新手教师,这些新手与经验丰富的教育者不同,他们难以解决学生的错误,因此未能抓住主要的学习机会。我们的工作探讨了大型语言模式(LLMS)在修复数学错误时缩小新手 - 专家知识差距的潜力。我们贡献了桥梁,这种方法使用认知任务分析将专家的思维过程转化为一个决策模型进行补救。这涉及识别(a)学生错误,(b)修复策略的例外,以及(c)在产生响应之前的进程。我们结构了一个由700个实际辅导转换的数据集,由专家及其决定的专家注释。我们在数据集中评估了最新的LLMS,并发现专家的决策模型对于LLMS缩小差距至关重要:与专家决策(例如,“简化问题”)的GPT4响应是 +76%的首选。补充,上下文敏感的决策对于缩小教学差距至关重要:随机决策与专家决策相比,GPT4的响应质量降低-97%。我们的工作表明了嵌入专家思维过程的潜力,以增强他们的帽子,以弥合新手 - 专家知识差距。我们的数据集和代码可以在以下网址找到:https://github.com/rosewang2008/bridge。

学习还是回忆?通过预先...

主要关键词