机构名称:

¥ 1.0

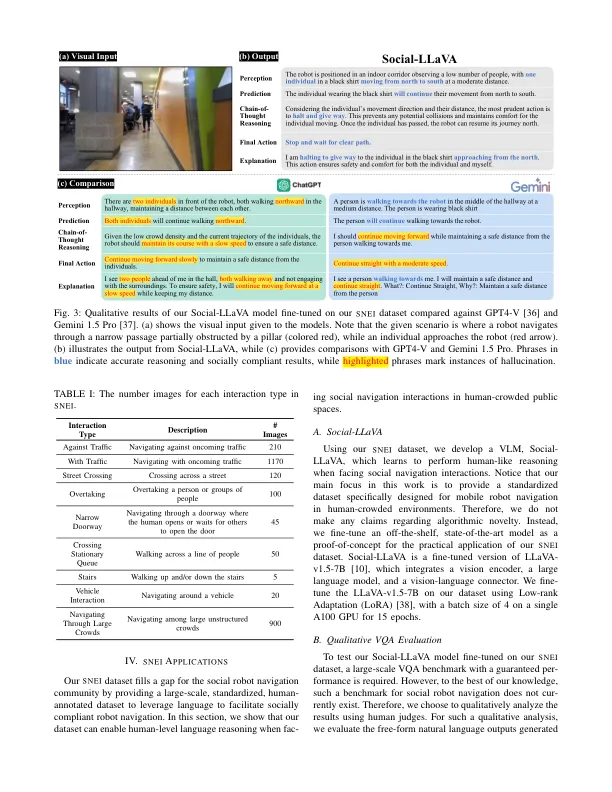

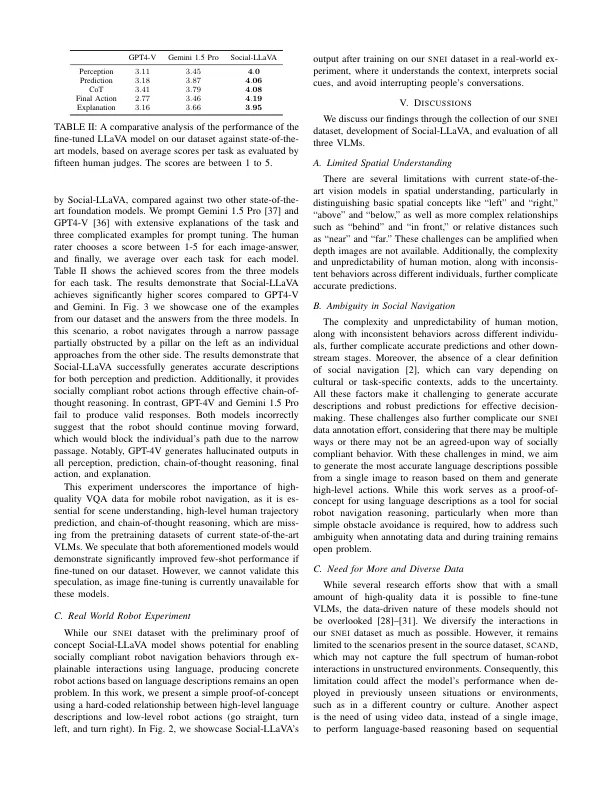

摘要 - 大多数现有的社会机器人导航技术要么利用手工制作的规则,要么是人类的示范,以将机器人感知与社会兼容的行动联系起来。但是,有效地将感知转化为具有社会符合社会的行动,就像人类推理在动态环境中自然发生一样。考虑到视觉模型(VLM)的最新成功,我们建议使用语言来弥合感知和具有社会意识的机器人行动之间类似人类的推理的差距。我们通过可解释的互动(SNEI)创建了一个视觉语言数据集,社交机器人导航,特征是基于2K人类机器人社交互动的40k人类通知的视觉问题答案(VQA),在非结构化的,拥挤的公共空间,跨越的公共空间,跨越感知,预测,预测,预测,三连锁推理,链的推理,行动,动作,动作,动作和解释。我们使用Snei微调了VLM,社交式,以演示我们数据集的实际应用。社交式的表现优于诸如GPT-4V和Gemini的最新模型,基于50个VQA的15种不同的人为法官得分的平均值。在船上部署了一个移动机器人,社交式实现了类似人类的推理,这标志着通过语言推理在动态公共空间中朝着社会兼容的机器人导航迈出的有希望的一步。

社交式:通过社会空间中的人类语言推理增强机器人导航

主要关键词